(文/万肇生 编辑/张广凯)

最近几个月,龙虾(OpenClaw)的爆火有目共睹,但在刚刚过去的清明假期间,有一部分龙虾用户破大防了。

全球AI巨头Anthropic已宣布,自4月5日起,旗下大模型Claude(克劳德)的订阅服务,将不再覆盖包括龙虾在内的第三方集成工具。用户如想继续使用该模型,只能通过与订阅服务分开计费的按需付费方案,并需要为此支付额外费用。

Claude就是美国帕兰蒂尔公司“梅文智能系统”战场情报平台中,所嵌入的那个大模型。有报道称,Claude通过分析来自卫星、监控系统及其他情报渠道的机密数据,为美以在伊朗的军事行动提供实时目标锁定与优先级排序,一时间神话了该模型并让其破圈。

但是,Claude封杀龙虾的消息一出,社交平台哀鸿遍野。此举意味着成千上万决定坚持调用这款具有强劲编程能力模型的龙虾用户,都将被迫转入极其昂贵的“按量计费”模式,直面天价的算力账单。对此,Claude Code负责人切尔尼(Boris Cherny)在社交平台X发文解释称,公司的订阅服务并非针对这类第三方工具的使用模式而设计,在订阅服务封禁第三方工具是为了平衡服务器资源,以便更好更可持续地服务用户。

对于官方的解释,用户们似乎并不买账,舆论很快从技术层面转向商业竞争,各种阴谋论、商战剧本甚嚣尘上,其中最引人注目的当属“龙虾之父被挖角”的说法。

封杀令落地:龙虾用户“破防”

“龙虾之父”指的是开发者斯坦伯格(Peter Steinberger)。他最早基于Claude开发了名为“ClawdBot”的工具,这名字明摆着致敬Claude,后来在Anthropic的要求下才更名为“龙虾”(OpenClaw)。因此,斯坦伯格本人显然也对Claude的生态系统了如指掌。但就在不久前,斯坦伯格被Anthropic的劲敌OpenAI挖走。这一时间点与此次封禁事件如此接近,很难不让人浮想联翩。

当地时间2月14日,斯坦伯格(中戴帽者)发文称自己即将加入OpenAI斯坦伯格个人账号

另一方面,就在两周前,Anthropic还刚刚宣布为Claude引入“Computer Use”能力。在Claude Cowork和Claude Code中,用户可以直接让Claude操作用户的Mac电脑,实现与“龙虾”相似的功能。

如果将这两件事串联起来,一个典型的商战逻辑便浮出水面。既然竞争对手挖走了我的核心生态开发者,那我就用官方功能直接替代你的第三方工具,再切断你的订阅通道,让你要么用我的官方方案,要么付出高昂代价。这样的剧本听起来合情合理,甚至有些“痛快”。

然而,在小米MiMo大模型负责人、“95后天才少女”罗福莉看来,事情远非简单的商业报复,而是行业普遍的算力浪费顽疾。

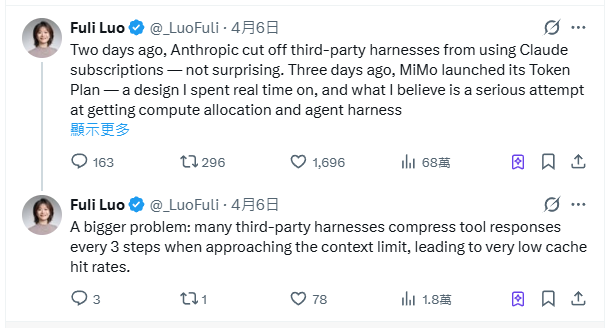

4月7日,罗福莉在个人社交账号上发布了一篇长文,对此次事件进行了系统性的剖析。她表示,小米的Mimo近期推出的“Token计划”在计算资源分配方面,再结合Anthropic切断第三方工具使用Claude订阅通道的事情,自己得出了几点看法。

罗福莉拆解的算力账

首先,罗福莉认为,Claude Code的订阅模式是一个设计精美的系统,用于平衡计算资源分配,但可能不赚钱甚至在亏钱,除非Claude的API利润率能达到10到20倍。然而,她经研究发现,龙虾的上下文管理非常糟糕,在单个用户查询中,它会以独立的API请求形式发起多轮低价值工具调用,每一轮都携带很长的上下文窗口(通常超过10万个词元),即使有缓存命中也很浪费。

其次,许多第三方工具在接近大模型一次能处理的上下文限制时,每三步就对工具返回的原始数据进行一次压缩,来防止大模型无法继续任务。但这样做的话,因为缓存内容出现了变化,每次都需要重新计算,缓存命中率自然极低,直接导致计算成本和延迟大幅上升。

这些原因加在一起导致了每个查询的实际请求次数,最终比Claude Code自身的框架高出好几倍。若换算成API定价,实际成本可能是订阅价格的数十倍,“这已经不是简单的差距了,这是鸿沟。”相当于Anthropic在为每一位使用订阅的龙虾用户倒贴钱,龙虾越火爆,那Anthropic亏的就越多。

“短期内,这批龙虾用户可能会感到痛苦,成本轻易飙升数十倍,“罗福莉表示,“但这种压力恰恰会推动这些工具改进上下文管理,最大化提示缓存命中率以复用已处理的上下文,减少浪费的算力消耗。痛苦最终转化为工程规范。”

罗福莉提醒,大模型公司在找到如何设计一个不亏钱的编码方案定价之前,最好不要盲目地打价格战。如果大模型厂商以极低的价格出售算力,同时对第三方工具敞开大门,这对用户来说看似美好,但这是一个陷阱,也正是Anthropic刚刚走出的那个陷阱。当用户把注意力消耗在那些低质量的智能体工具、极不稳定且缓慢的推理服务、以及为了降成本而阉割的模型上,最终结果会发现,仍然什么都做不成。这无论是对用户体验,还是用户的留存来说,都不可持续。

而由于目前全球计算能力,都跟不上智能体所产生的算力需求。因此罗福莉认为,真正的出路不是更便宜的算力,而是协同进化。比如更高效的智能体工具搭配更高效的模型。Anthropic的这一举动,无论是否有意,都在推动整个行业生态系统朝着这个方向前进。“这可能是件好事。智能体时代不属于谁消耗的计算最多,它属于谁用得最明智。”

算力焦虑的终结是效率革命

罗福莉对Anthropic封禁“龙虾”事件的分析,实际上戳中了当前AI行业最深层的算力浪费问题,让人想起2025年初那个震动全球AI行业的“DeepSeek时刻”。

当时,“算力焦虑”推动英伟达股价水涨船高,但DeepSeek-R1横空出世,增量训练成本仅29.4万美元,即便计入约600万美元的基础模型开发费用,整体开销仍远低于行业普遍水平,可它的性能在多项评测中与OpenAI耗资数亿美元打造的模型不相上下。

3月27日,罗福莉在中关村论坛年会圆桌论坛环节分享龙虾的核心价值点。

曾参与过DeepSeek开发的罗福莉,深刻明白结构创新下的效率意义。DeepSeek靠的不是市场鼓吹的GPU集群暴力堆砌,而是从稀疏注意力的工程实现,到在有限算力下把性价比发挥到极致,实现了算法创新与工程优化的合力。就如同罗福莉本人曾在中关村论坛上说过的那样,中国大模型团队的优势,是在低端算力限制下,通过模型结构创新去追求最高效率。

但随着人工智能在各行各业的普及,技术层面瓶颈导致了算力的巨大浪费问题,“算力焦虑”再次卷土重来,并严重推高了内存价格。市场默认的“算力=性能”的粗暴等式,本质其实都是稀缺性幻觉。但算力芯片巨大的内存需求,直接导致多家手机厂商纷纷官宣涨价、消费级显卡延期,最终一圈下来,影响的还是普通消费者。

退一万步说,DeepSeek去年已经给出了可行性,而今年“龙虾”们的涅槃重生,也必将从效率优化开始。