我们对未来的想象力,可能被锁死了。

现在大家纠结的,是AI写的文案有股人机味,是它能不能帮我工作让我早点下班。

Steve Newman泼了一盆冷水:别盯着那些多出来的手指看了!那只是技术演化早期的「噪音」。

他引用了阿马拉定律——技术的短期影响往往被高估,而长期潜力却总被低估。

我们现在觉得AI添乱,是因为它还在努力模仿人类;可一旦它跨过那个「适应性阈值」,它将以人类完全无法理解的速度自我克隆。

一旦跨过这条红线,我们即将进入一个「不可认知时代」。

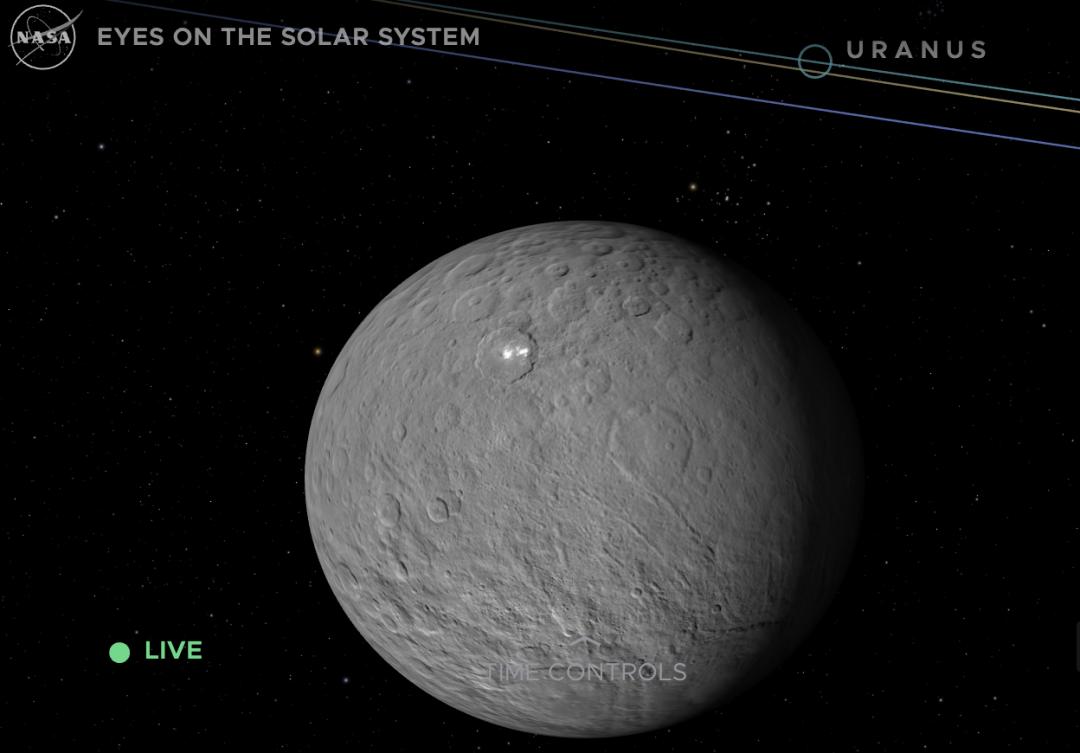

谷神星设想

当增长不再需要「说服」人类

Steve Newman在文中提出「谷神星(Ceres)实验」,听起来十分魔幻:

2055年,人类在小行星带部署了一套全自动工业体系。从采矿、能源到芯片制造,全部由AI驱动。

这套系统唯一的任务,就是指数级地自我复制。

为什么地点必须选在「地球之外」?

在地球上,任何技术的推进,本质上都是一场漫长且疲惫的社会协商。

要通过环境评估,要处理就业保护,要平衡政治博弈和既得利益。

在这里,技术进步被包裹在各种「结构性摩擦」之中,走一步退三步。

但在小行星带,摩擦力消失了。在谷神星上,AI面对的只有材料强度、能量供给和物理定律。

增长,第一次不需要「说服」任何人。

更令人战栗的是增长的逻辑。

在Newman的设想中,会像生物病毒一样指数级自我复制。从1万到2万,从2万到4万……20年后,将达到10万亿。

在生物界,这种增长通常意味着灾难;但在机械系统中,它代表着极致的效率。

这正是Newman想要强调的「文明断裂点」:没有失业,因为那里从未雇佣过人类;没有抗议,因为工业不在地球;没有政治,因为算法不需要选票。

当然,这只是一个极端的隐喻。但现实的发展一定会更混乱、更笨拙。

这个隐喻揭示了一个残酷的真相:一旦AI跨过某个自主性的阈值,人类社会将不再是必经之路。

当技术演化不再需要配合人类的节奏,我们所熟悉的那个世界,就开始变得难以辨认了。

劳动力终结

「人」不再是增长的锚点

人类所有的经济体系中,有一个前提:资本可以扩张,但劳动力不行。

你可以建更多的工厂、印更多的钞票,但「人」永远是一个慢变量。

培养一个熟练的工人、工程师或研究员,需要漫长的时间、昂贵的教育以及不可逆的经验积累。

正因为这种稀缺性,才有了工资、就业、福利制度,以及以此为基础的现代文明。

但Steve Newman指出:

一旦劳动力具备了「可扩展性(Scalable Labor)」,整套结构将被粉碎。

在他的设想里,AI将替代并超越人类,成为「可无限复制的劳动力单元」。

培养一个成熟的人类专家需要20年;用AI克隆一个顶尖的数字大脑,只需要几秒。

历史上,技术进步总是伴随着旧岗位的淘汰,同时创造出新的瓶颈。

正如蒸汽机淘汰了体力劳动,却也放大了管理、工程、组织的需求;计算机将计算自动化,却让「认知劳动」更重要。

但Newman担忧的是:

当AI不仅能干活,还能比人类更快地学会「下一件事」时,这种新的瓶颈可能不再出现了。

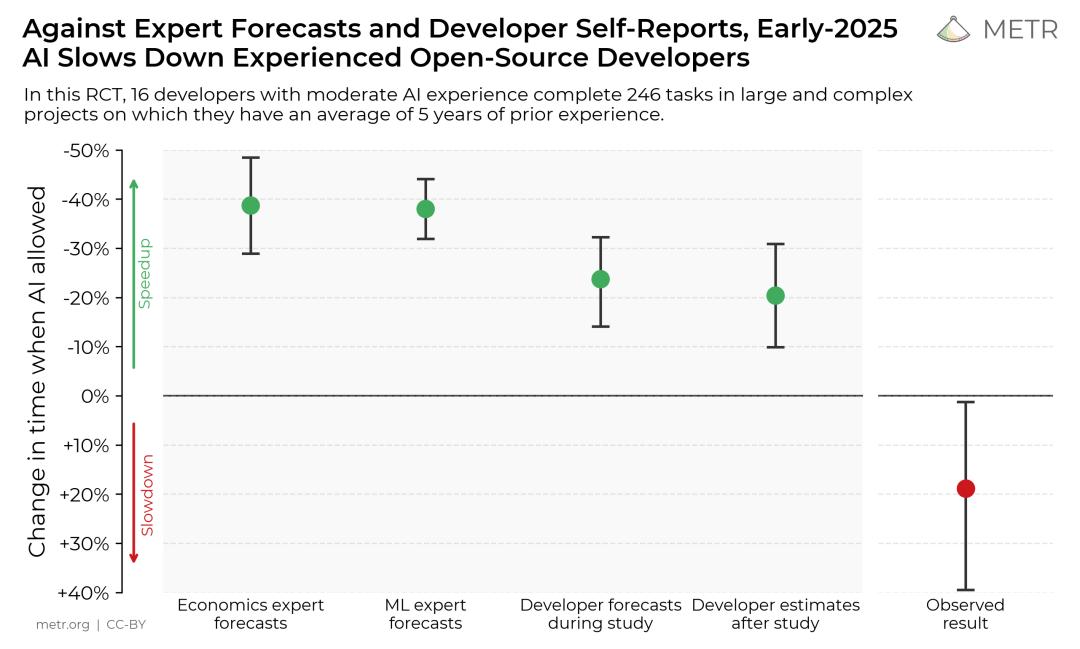

这种迹象在2025年已经初见端倪。虽然多项研究显示,当前的AI编程工具可能在复杂任务中拉低效率,但企业并没有停止投入。

行业逻辑已经发生了天翻地覆的变化:整个开发流程正在「默认AI参与」。

METR于2025年初进行的随机对照实验显示,在复杂真实任务中,允许使用AI的资深开源开发者平均完成时间反而更长。尽管如此,专家与开发者在事前与事后的主观预测仍普遍高估AI带来的效率提升。

最终的结果,可能不是裁员公告,而是根本不会有这种岗位。

Newman没有使用「失业危机」这种常见表述,而是更冷静地指出:

当劳动力变成一种像电力一样可以随时扩容、随处调度的资源,传统经济学中关于「工资、成本、价值」的直觉将彻底失去锚点。

如果绝大部分生产和研发都不再需要人类,那么「谁来消费、谁来支撑循环」这类问题,将成为认知危机。

我们赖以理解社会运转的那套语言,正在失效。而这,仅仅是第一层断裂。

科研失速

当「真理」产出超过人类的带宽

Steve Newman拆掉了科研界最后一个堡垒——人类的认知节奏。

他提出了一个后背发凉的设想:如果AI成了科研体系本身,会发生什么?

在谷神星的隐喻里,那万亿个「数字大脑」只负责推高人类知识的边界。

这种体系一旦成形,人类的整体研发能力将被放大到百万倍量级。

这不是说AI比爱因斯坦聪明一百万倍,而是科研第一次摆脱了「注意力」和「寿命」这两个人类专属的限制。

在人类的历史上,真正稀缺的从来不是灵感,而是验证灵感所需的时间。

一个理论要被验证,可能需要几十年;一个方向要被证明无效,也要耗掉一代人的职业生涯。

但在AI主导的体系中,失败几乎没有成本。模型可以并行探索无数路径,随时回滚、重组、再试。

这种趋势早已在现实中破土。在材料科学和蛋白质结构预测领域,AlphaFold重塑了结构生物学中「假设—验证」的节奏。

类似的变化也出现在新材料发现、催化剂筛选、药物分子设计中。

AI正在从「辅助者」变成「决策者」,由它来决定哪个方向值得投入,哪个方向该直接放弃。

但Newman真正担忧的,并不是效率的飞跃,而是「理解的滞后」:

当科研产出快到一定程度,世界的瓶颈将从「如何发现」转移到「如何理解」。

哪怕一个突破是正确的、有益的,人类社会是否来得及理解它的含义、评估它的风险、决定是否部署,都会成为问题。

这也是他提出「Unrecognizable Age(不可认知时代)」这个词的原因。

当生产、科研与部署形成了一个自我强化的闭环,人类才发现,自己正被AI飞速追赶。

历史坐标

临界点越来越近

Steve Newman试图将AI放在一个更宏观的历史坐标系里观察。

他判断——我们目前所处的阶段,本身就极其不寻常。

在进入农业社会之前,生产力几乎无法积累;而在农业社会之后,增长也极其缓慢,任何微小的技术进步往往都会被增长的人口迅速抵消。

这种「平滑」的状态持续了上千年。

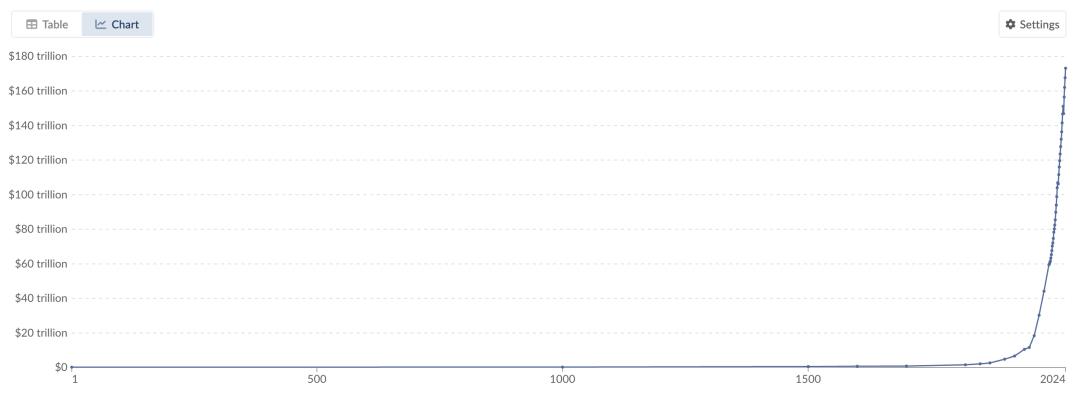

Our World in Data整理的Maddison Project数据显示,从公元 1 年到 1800 年,全球 GDP 的曲线几乎是贴着地面移动。真正的「起飞」和加速,仅仅发生在工业革命之后的这两百年里。

这也解释了为什么AI产业的投入规模显得如此「反常」。

Newman对比了一组极具冲击力的数据:在考虑通货膨胀因素后,当前全球用于AI数据中心和基础设施的年度资本支出,正迅速逼近、甚至可能在未来几年内超过二战时期美国峰值的军费投入。

历史上,每一次改变世界的技术跃迁,都必须同时满足三个硬性条件:技术路径初步可行、资本高度集中、社会具备承受长期试错的能力。

在Newman看来,AI正在逐一满足这些条件。即便眼下的路径遇到瓶颈,整个行业也已经同步开启了替代方案的探索,从模型架构到能源方案,无一缺席。

他用「里氏10.0级」来形容这种震荡——一旦发生,事后再去讨论「应不应该」,往往已经没有任何意义了。

站在今天回看历史,很容易产生一种错觉:一切发生的都顺理成章。

农业出现了,工业革命发生了,电力和信息技术铺开了。每一次转折,都能被解释为「条件成熟」「技术必然」。

但对身处其中的人来说,从来不是这样。

变化不是用嘴说出来的,而是以预算、基础设施、流程重写的方式,一点点累积。

Steve Newman想提醒的,正是这种「进行时」的危险感。

也许AI会经历泡沫,很多预言都会落空。

但只要投入规模、技术惯性和制度绑定没有松动,这个系统就很难简单退回原点。

参考资料:

https://secondthoughts.ai/p/the-unrecognizable-age