两年前的 WWDC 2024,Craig Federighi 站在 Apple Park 的舞台上,用一种精心克制的兴奋感宣布了 Apple Intelligence。

Siri 终于要变聪明了,ChatGPT 被请进了 iOS 生态,而苹果自研的小模型会在本地安静地处理你的邮件摘要和文本改写,当时台下的开发者,仿佛看到这样一个愿景。

那一刻,苹果似乎找到了一条既能拥抱生成式 AI 又不必放弃隐私叙事的中间路线。

两年后的今天,那条中间路线已经面目全非。

苹果 AI 负责人 John Giannandrea 被体面地「退休」,核心 AI 团队流失了十多位关键成员(其中大部分去了 Meta),Siri 的重大升级从 2025 年春天推迟到了 2026 年秋天,而苹果不得不以每年约 10 亿美元的价格向 Google 购买一个 1.2 万亿参数的 Gemini 模型来重建 Siri 的底层智能。

与此同时,Bloomberg 在本周报道了另一个重磅消息:iOS 27 将引入名为「Extensions」的新系统,允许任何第三方 AI 聊天机器人,包括 Claude、Gemini、Perplexity 等,通过 App Store 接入 Siri。

换句话说,苹果现在同时在做两件事,一边用 Google 的 Gemini 重建 Siri 的「大脑」,一边把 Siri 的「嘴巴」开放给所有竞争对手。这是一套复杂的双线并行策略,既是无奈之举,也是精明的平台算计。

但要理解它的全貌,需要先回溯过去两年苹果在 AI 领域反复摇摆的轨迹。

短短两年,Siri 转向三次

2024 年 WWDC 上亮相的 Apple Intelligence 架构曾经非常清晰:苹果自研小模型处理本地任务,当用户遇到 Siri 无法处理的复杂问题时,系统会征求用户同意后将请求转发给 ChatGPT。

这是一种「内核自研、外脑外包」的分层结构,OpenAI 扮演的是唯一的外部智能供应商。

但问题很快暴露。苹果自研模型的参数规模有限——本地模型约 30 亿参数,云端模型约 1500 亿参数,在推理能力和世界知识方面与 GPT-4 级别的模型差距明显。

更致命的是,WWDC 上演示的 Siri 高级功能,例如个人上下文理解、屏幕感知、跨应用操作,在发布时根本没有准备好。苹果一边在 iPhone 16 的营销中大力宣传这些功能,一边不得不在 2025 年初承认「需要更长时间来实现」。这是第一次转向的伏笔。

2025 年,对苹果 AI 团队来说是一场风暴。

Siri 升级被推迟后,苹果内部进行了组织重组:

Siri 从 Giannandrea 的管辖范围被移走,交给了 Vision Pro 负责人 Mike Rockwell

机器人团队被划归硬件部门

Giannandrea 的团队被缩减为只专注于 Apple Foundation Models 的研发,这在外界看来更像是一种降权而非聚焦。

John Giannandrea

随之而来的是苹果 AI 人才团队整个大出血。Foundation Models 团队的创始人兼首席科学家 Ruoming Pang 被 Meta 以据报道超过 2 亿美元的薪酬挖走,十多名核心研究员相继离开,大部分加入了 Meta 的超级智能实验室。

苹果 AI 团队在内部甚至被戏称为「AIMLess」——取自 AIML(人工智能与机器学习)的缩写,同时谐音 aimless,意为漫无目的。

2025 年 12 月,Giannandrea 正式宣布将在 2026 年春天退休。接替他的是 Amar Subramanya,一个在 Google 工作了 16 年、曾领导 Gemini Assistant 工程团队的人。

几乎同一时期,苹果与 Google 的 AI 合作从传言变成了现实。2025 年 11 月 Bloomberg 报道了约 10 亿美元年费的交易框架,2026 年 1 月 12 日双方发布联合声明正式确认,Apple Foundation Models 的下一代将基于 Google 的 Gemini 模型和云技术构建。

值得注意的是,苹果在做出这一决定前曾在内部对多家 AI 公司的模型进行了「bake-off」测试,Anthropic 也在被考虑之列,而最终选择 Google 的关键因素据说不是模型性能,而是价格和基础设施的成熟度。这是第二次转向。

本周的消息则补全了第三块拼图。在用 Gemini 重建 Siri 底层能力的同时,苹果还在 iOS 27 中准备了一个完全独立的「Extensions」系统,允许第三方 AI 聊天机器人以 App Store 应用的形式接入 Siri。

未来,用户可以选择启用哪些 Siri 服务,甚至可以为不同类型的查询指定不同的 AI 后端。

这意味着苹果现在同时运营着三层 AI 架构:最底层是 Apple Foundation Models(基于 Gemini 训练的蒸馏模型,运行在设备端和 Private Cloud Compute 上),中间层是 Siri 自身的对话和任务执行能力,最外层是通过 Extensions 接入的第三方 AI 服务。

三层之间的关系并非替代,而是互补,至少在苹果的设想中是这样。

苹果 AI 重新洗牌

这套新架构对 AI 行业各方的影响并不均匀。

Google 是毫无疑问的最大赢家。它在这场交易中获得了一个极为罕见的双重地位,既作为苹果 AI 基础设施的底层供应商拿到了每年约 10 亿美元的合同,又可以通过 Gemini app 以 Extensions 的形式直接触达数十亿 iOS 用户。

但硬币的另一面是,Extensions 的出现也稀释了 Gemini 的独占叙事。

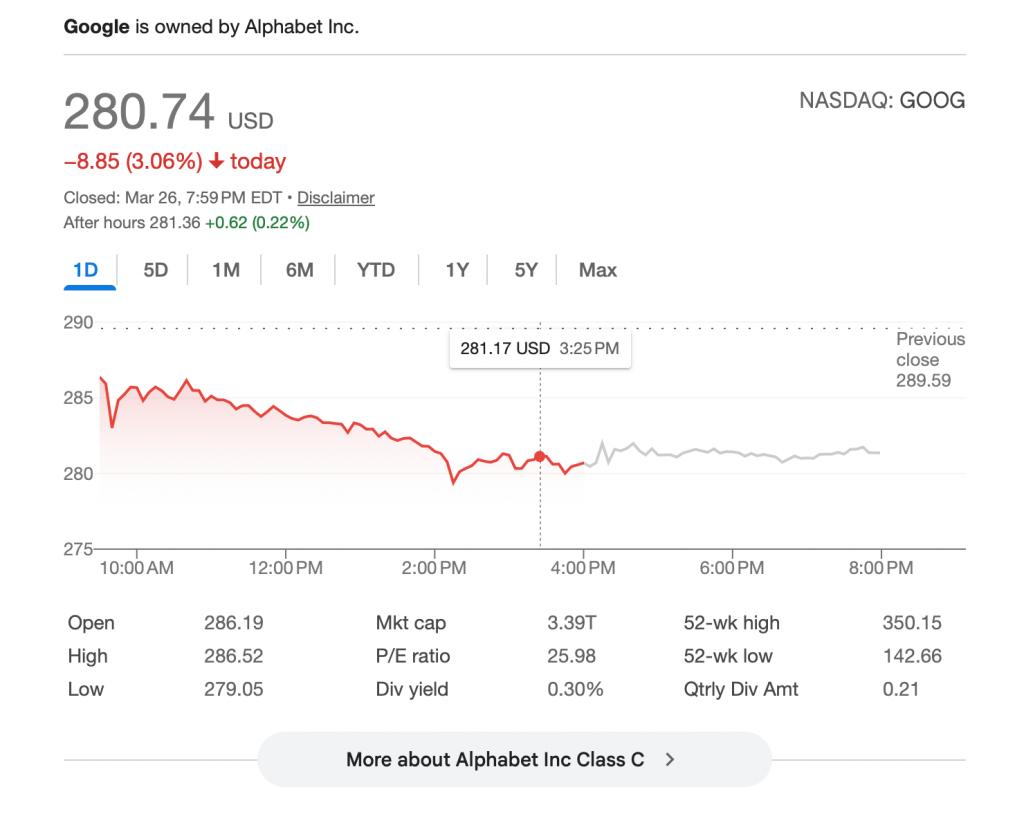

在 Extensions 货架上,Gemini 的 app 版本和 Claude、Perplexity 站在同一排,Google 股价在本周消息公布当天盘中跌至当日最低点、收盘跌 3.06%,正是市场对这一层面的即时反应。Google 同时是最大赢家和部分输家,取决于你看的是哪条线。

对于 Anthropic 和 Perplexity 这类垂直 AI 公司,几乎可以说是最大的赢家,获得了一个此前不存在的分发渠道。

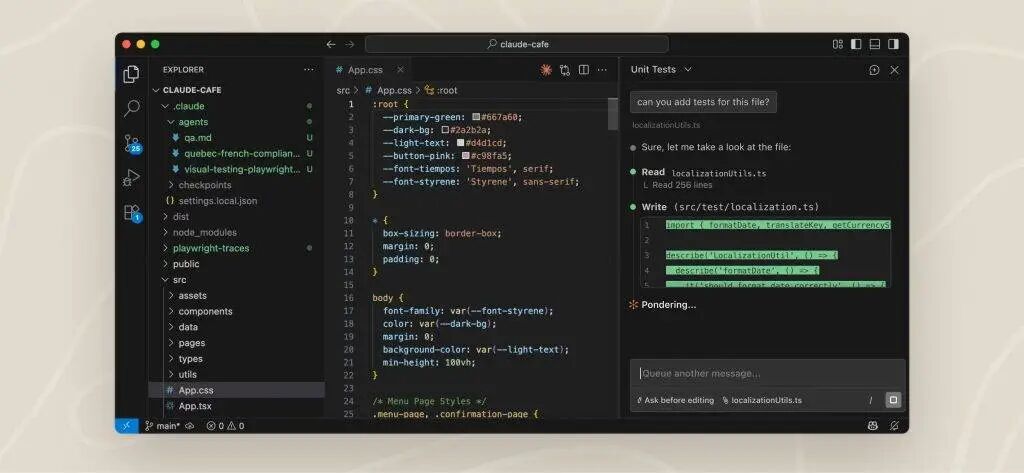

在爆料中,Claude 被直接指出是能够通过 Extensions 接入 Siri 的服务之一。对 Anthropic 而言,这意味着无需与苹果单独谈判整合协议就能获得 iOS 用户的入口,考虑到 Claude 在编程辅助和长文本理解方面的差异化优势,它有机会成为技术用户在 Siri 中的首选外脑。

Perplexity 的在搜索场景的能力不输任何一家大牌 AI,但知名度和对用户的触达能力要略逊一筹。Extensions 的推出,让 Perplexity 和竞争对手站在了同一起跑线。

在国内语境下,Extensions 更利好的是像 Kimi 这样模型能力出众、却缺少国民级入口的 AI 服务商;而对于腾讯元宝这类平台声量远高于模型实力的「分发者」,则无异于一次重击。

从本质上来说,Extensions 把 Siri 变成了一个 AI 服务的分发平台,对所有有 App Store 应用的 AI 公司来说都是增量机会。

至于苹果,他们大概率会和 App Store 一样继续「躺赢」,在 Siri 入口抽取订阅的 15%-30% 不等的「苹果税」。

AI 订阅正在成为科技行业增长最快的收入来源之一,苹果不需要赢得 AI 模型的竞赛,只需要确保所有 AI 模型都必须经过它的收银台。你们比谁更聪明,我来收过路费。

App Store 通过 15%-30% 的抽成,实现了 4000 亿美元的年收入,随着生成式 AI 继续爆发,谁也说不准 Siri Extensions 会不会成为苹果营收的下一个大头。

承受压力最大的无疑是 OpenAI。自 2024 年底以来,ChatGPT 一直是 Siri 内唯一的第三方 AI 服务,这个独占地位即将终结。

Extensions 系统则相当于消除像 ChatGPT 这样的一次性整合交易的必要性,OpenAI 从「苹果官方唯一合作伙伴」,变成了和 Google、Anthropic 这些对手站在同一起跑线,叙事上的降级不可避免。

更值得玩味的是,苹果在决定与 OpenAI 合作时,内部就已经存在分歧,Giannandrea 质疑 OpenAI 的长期稳定性而倾向于 Google。

现在来看,苹果先选了 OpenAI 做过渡方案,再用 Google 做底层重建,最终通过 Extensions 把所有人拉到同一起跑线。OpenAI 在这个过程中扮演的角色更像是一个先行者折扣的接受者,而非长期战略伙伴。

苹果自研 AI 团队本身,也将会成为这个新入口的「牺牲者」。即使果官方表示仍在开发自己的 1 万亿参数云端模型,希望最终替代 Gemini,但现实是核心团队已经流失大半,新负责人 Subramanya 本人就是从 Google 来的 Gemini 老将,而依赖外部模型的惯性一旦形成就很难逆转。

苹果的自研 AI 雄心正在从「战略目标」,似乎正在悄悄滑向「公关话术」。

放弃自研,Apple 智能还有「果味」吗?

所以,苹果为什么不简单地选一条路走到底,而是同时推进 Gemini 底层合作和 Extensions 开放平台两条线?

最直接的原因是,自研模型已经没有了一个确切的交付时间表。

苹果原本计划用自研模型驱动 AI Siri 2.0,但两次跳票之后,继续对外宣称「我们自己能搞定」已经缺乏说服力。与 Google 合作是一个务实的止血方案,用成熟的外部能力先把产品做出来,再在内部慢慢追赶。

而 Extensions 的逻辑则更具战略纵深。AI 模型市场的格局变化太快,2024 年的 ChatGPT 是行业共识的最佳选择,但到了 2025 年底 Gemini 已经赶上甚至超过 GPT-4,Claude 在长文本和编程领域建立了差异化优势,开源模型也在快速缩小差距。

押注单一供应商的风险太高,Extensions 本质上是一个对冲策略,苹果不再替用户选择哪个 AI 最好,而是搭建一个让所有 AI 竞争的擂台,自己做裁判和收银员。

更深一层看,这也符合苹果一贯的平台逻辑。回顾 App Store 的历史,苹果从来不擅长也不热衷于自己做最好的应用,但它极其擅长建设一个让别人来做应用的平台并从中收取通道费。将同样的模式复制到 AI 领域,是苹果最自然的选择。

但双线并行并非没有代价。

体验割裂是最直观的风险。目前 Siri 的 ChatGPT 集成体验感极差,每次都需要用户主动用指令调起。未来接入多个 AI 服务后,如果用户每次唤起 Siri 都需要手动指定「用 Gemini 回答」还是「用 Claude 回答」,体验大概率是碎片化的。

苹果一直以来的产品哲学是替用户做选择、降低认知负担,而 Extensions 系统把选择权还给了用户,这在理念上是自由的,但在体验上可能是混乱的。

苹果需要设计一个足够智能的路由层让 Siri 自动判断哪个后端最适合当前查询,但这本身就需要一个足够强大的 AI 来实现,而这恰恰是苹果目前最薄弱的环节。

隐私叙事的动摇则更加深层。Apple 智能的核心卖点一直是「你的数据不会离开苹果的生态系统」。苹果声称 Gemini 合作中的数据运行在 Apple 的 Private Cloud Compute 上且不与 Google 共享,但通过 Extensions 接入的第三方服务是否也能享受同等保护,目前完全不清楚。

Apple 智能:行业领先的 AI 隐私

如果不同 AI 服务有不同的数据处理标准,苹果的隐私承诺就会变得复杂且难以验证,对于一个把隐私当作核心品牌资产的公司来说,这种模糊性本身就是一种风险。

而最值得长期关注的隐患是战略依赖的不可逆性。苹果坚称 Gemini 只是过渡方案,最终会用自研模型替代。但历史上有太多「暂时使用外部技术」最终变成永久依赖的案例。

一旦数十亿 iPhone 用户习惯了由 Gemini 驱动的 Siri 体验,苹果如果要切换到自研模型,就必须确保体验不出现任何退步,这对一个仍在追赶阶段、核心研究员已经大量流失的自研团队来说,几乎是不可能完成的任务。

更何况,Google 完全有动机通过持续升级 Gemini 来提高苹果的切换成本。当你最重要的产品的智能核心运行在竞争对手的技术之上,「过渡」和「永久」之间的距离可能比你想象的要短得多。

两年前,苹果试图用一个精巧的分层架构来回避「到底谁才是 iPhone 的 AI 大脑」这个问题。两年后,这个问题不仅没有被回避,反而变得更加尖锐:答案现在是 Google、OpenAI、Anthropic、Perplexity……以及一个仍然需要证明自己的苹果自研团队。

北京时间 6 月 9 日的 WWDC 将是一个关键节点。届时我们会知道苹果是否真的找到了一种方式让这些互相竞争的 AI 服务在 Siri 的外壳下和谐共存,还是说它只是在一个迟钝的前台增加了更多的转接线路,而每条线路都通向别人的大脑。

对于苹果来说,最大的赌注并非 Gemini 够不够好,也不是 Extensions 能不能带来新的服务收入,而是一次对苹果体验的挑战:当你把 AI 的核心能力分散到多个外部供应商手中,还能维持「就是好用」(it just works)这个金字招牌背后的承诺吗?

这是一个苹果从来没有面对过的问题。