每当我们听到“脑机接口”(BCI)这个词,就会联想到“意念控制”——你出想法,机器代为执行。这听起来很酷,但实现起来可没那么简单。

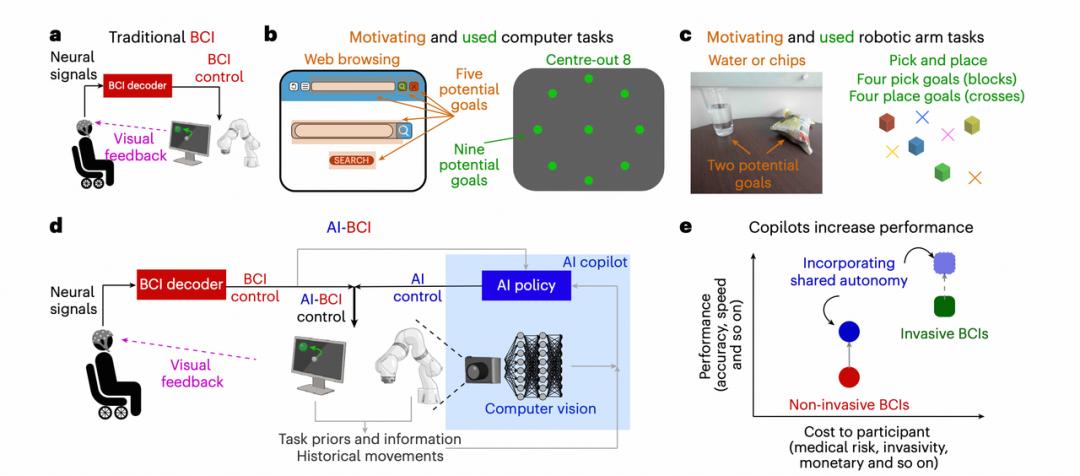

传统 BCI 就像一个“死板的助手”,只能被动读取大脑信号,努力完成指令。结果就是:效率不高、准确度有限,用户还得时刻盯着,连细节都要亲自操心,操作起来既慢又累。

如今,加州大学洛杉矶分校团队带来了不一样的思路:由人工智能(AI)担任“副驾驶”(copilot)。

BCI 系统不再只帮你“选按钮”或“代劳执行”,而是和你真正分工合作:你专注做决策,它借助 AI 完成预测、辅助和随时修正。整个过程,人机实时互动,默契配合。而且,这一非侵入性脑机接口系统,成功让瘫痪受试者在移动计算机光标这类任务中的表现提升了近 4 倍。

相关研究论文以“Brain–computer interface control with artificial intelligence copilots”为题,已发表在科学期刊《自然-机器智能》上。

论文链接:https://www.nature.com/articles/s42256-025-01090-y

这种共享操控模式或使脑机接口在日常使用中更实用、更高效,随着 AI 系统的升级,它们或能帮助用户更轻松地完成更多复杂任务。

或许,我们离“意念操作”的畅快体验,真的不远了。

传统脑机接口不够好?AI加“外挂”!

运动型 BCI 通过解码神经信号,帮助瘫痪患者实现运动和交流。尽管过去二十年取得了显著进展,但在临床应用中,BCI 仍面临核心挑战:系统性能必须足够强大,才能抵消其成本与潜在风险。

在大多数传统运动型 BCI 中,例如控制计算机光标或机械臂,唯一的控制来源是解码后的神经信号。然而,现实任务往往是以目标为导向的——动作的目的是接触或点击特定对象,例如计算机上的搜索栏、按钮、图标,或现实中的杯子、薯片、门把手、钥匙、积木等。

在这种场景下,只要能够准确判断用户的目标——即在有限可能目标中进行推断——基本就能确定动作方向。一旦目标明确,人类行为往往呈现固定模式,此时便可以借助“副驾驶”进行辅助。

这种方式被称为共享自治:人类用户(“驾驶员”)与 AI 副驾驶共同参与控制,从而提升操作性能。

那么,如何推断用户的目标?系统可以结合多种信息来源,包括任务结构、历史动作以及计算机视觉(CV)识别等。通过整合这些信息,系统能够更准确地推测用户意图,并辅助执行动作。

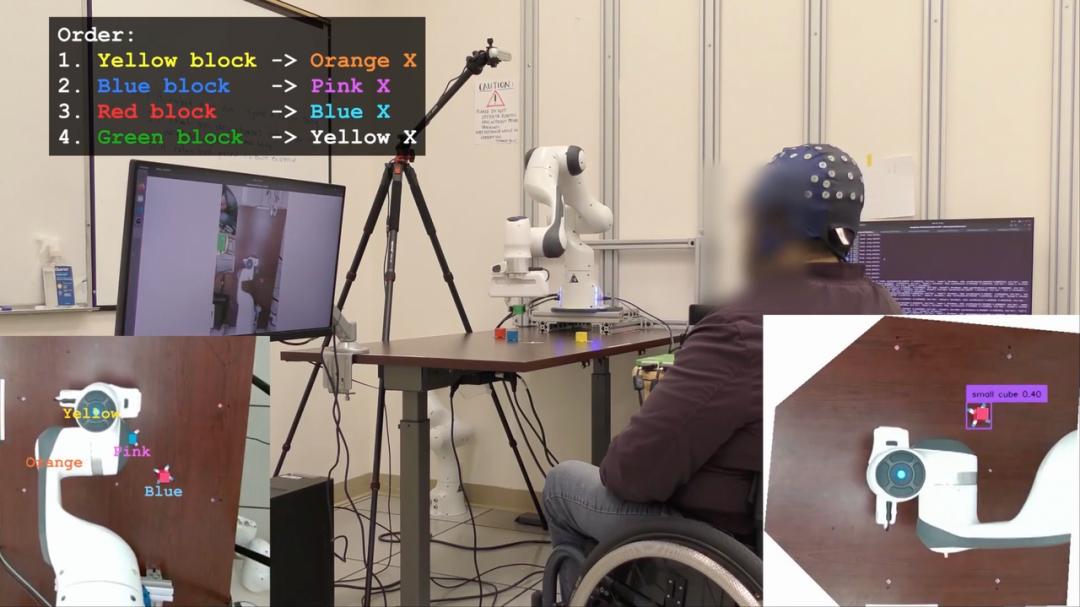

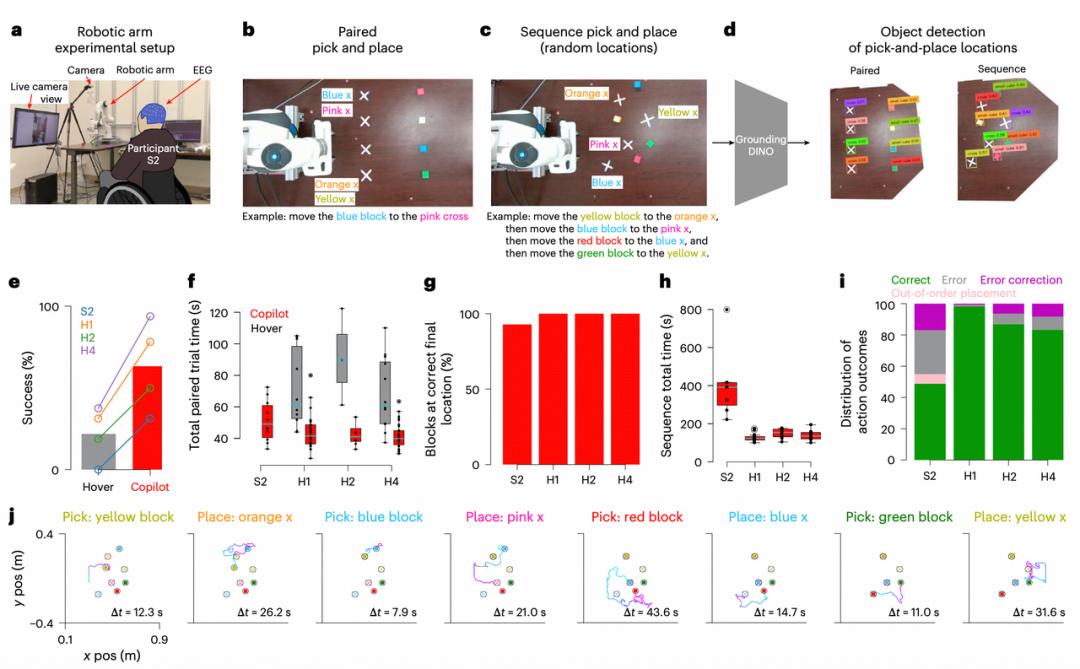

图|在 AI-BCI 中,AI copilot 利用任务信息提升 BCI 性能。

研究团队将这种架构称为 AI-BCI。在计算机相关任务中,也可以采用类似方法进行目标推断。例如,在使用搜索引擎时,用户的目标很可能是在输入关键词后点击“搜索”按钮;在输入操作中,上下文信息往往能为下一个字符选择提供强有力的提示。

即使任务本身没有明确目标,例如自由绘图,AI 副驾驶依然能够发挥作用——帮助规避常见错误或极端动作(如绘画时的剧烈抖动)。

最后,当无法获取任何任务相关信息时,该 AI-BCI 系统仍可切换回传统 BCI 模式,继续运行。

AI-BCI:让光标和机械臂更“听话”

为显著提升 BCI 性能,研究团队采用了共享自治方案:AI 副驾驶与 BCI 使用者协同工作,共同完成任务目标,从而让瘫痪患者能够熟练操控计算机光标和机械臂。

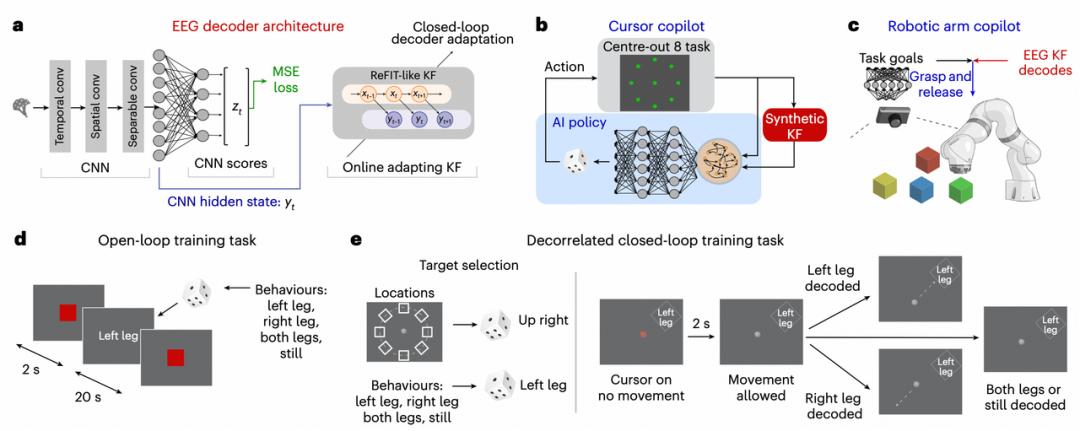

研究团队开发了一种新的脑电图(EEG)解码架构:该架构将卷积神经网络(CNN)提取的非线性特征作为卡尔曼滤波器(KF)的观测输入,类似于重新校准反馈意图训练 KF(ReFIT-KF),从而实现在线闭环解码器自适应(CLDA)。

他们对该解码器架构在多天实验中的性能进行了评估。在此基础上,他们展示了两种 AI 副驾驶系统:

光标控制系统:使用深度强化学习进行训练,实现智能辅助光标操作;

机械臂控制系统:结合计算机视觉技术,可自动识别物体并执行抓取或放置操作。

图|用于 center-out 8 和机械臂任务的 CNN-KF 与 AI-BCI 解码框架

在光标控制任务中,研究团队提出假设:能够推断用户目标的 AI 副驾驶能够显著提升任务表现。他们模拟了现实中“可选目标有限”的情境,例如计算机屏幕上的按钮或键盘按键。

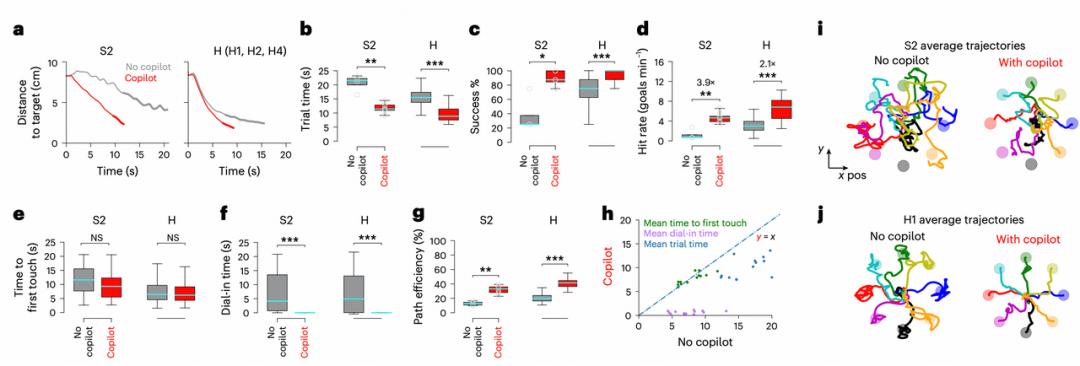

实验结果显示,光标副驾驶系统显著提高了任务效率:健康参与者的平均目标获取速率提升了 2.1 倍,瘫痪参与者提升了 3.9 倍。尤其对瘫痪参与者而言,AI-BCI 显著缩短了接入时间(dial-in time),从中位数 4.15 秒下降至 0.05 秒。同时,光标路径更加高效,几乎沿直线直达目标。

图|AI 副驾驶在 centre-out 8 task 任务中显著提升光标控制能力

在机械臂实验中,AI 副驾驶利用 CV 系统推测目标位置并持续跟踪物体。他们设计的副驾驶程序能够识别所有目标,并在机械臂距离积木或十字目标 2.54 厘米范围内时,实时辅助执行精确的抓取或放置操作。

图|副驾驶改进了机械臂的控制,以执行拾取和放置任务。

实验结果显示,在 AI 副驾驶的辅助下,所有参与者的成功率均有显著提升:所有参与者均成功完成了任务;健康参与者的物体正确放置率达 100%;瘫痪参与者在没有 AI 副驾驶的情况下无法完成任何成功试验,但有了 AI 副驾驶后,其正确放置率达到 93%。

AI-BCI 的未来形态是什么?

研究结果表明,在光标控制和机械臂任务中,共享自治显著提升了 BCI 的整体性能。这一方法为提升 BCI 效能提供了一条互补路径,随着 AI 副驾驶技术的不断进步,AI-BCI 的表现有望进一步增强。性能提升的关键在于:AI 能够辅助用户更高效地实现目标。

研究团队指出,AI 副驾驶能够减少完成高维任务所需的神经解码自由度(DOFs)。对于更复杂的任务,例如与特定物体交互,通过训练副驾驶处理这些操作,可进一步降低用户所需的控制自由度。

虽然已有研究展示了能够根据分类目标执行动作的机器人,但这些方法存在局限:AI 副驾驶并未与用户实现实时共享控制。而共享自治则允许用户与 AI 副驾驶持续交互,即使在缺乏明确目标的情况下,也可自动转为传统 BCI 模式。

研究团队预测,未来的 AI 副驾驶系统将提供更强大的辅助能力。这正是共享自治的核心目标:在任务执行过程中与用户共享控制权,从而全面提升人类在各类任务中的表现。未来研究应聚焦于:

开发更先进的 AI 副驾驶,实现面向物体的机械臂轨迹控制,并根据物体动态进行精确操作;

保留用户主导权,避免操作受限导致的挫败感与性能下降,为此提出“干预式辅助”的控制共享策略;

推动共享自治在更复杂的机器人系统中应用,包括通过大规模数据训练的模型,使 AI-BCI 胜任更高难度的运动任务;

促进任务标准化,并利用副驾驶提升侵入式 BCI 的性能。

总体而言,当 AI 副驾驶能够准确推断用户意图时,其辅助效果最佳;若无法解码用户意图,则难以完成目标。因此,未来工作可能集中于构建更优解码器,以进一步提升性能。

此外,其他类型的非侵入式信号也可能成为未来 BCI 的重要信息来源,包括眼动、姿态、肌电等辅助信号。这些信号可与 EEG 协同使用,尤其在 EEG 控制能力较弱的用户中,可显著提升系统整体表现。