最近一段时间,国内互联网行业最热的概念非“龙虾”(OpenClaw)莫属。在各路急着卖Token(词元)的大厂铺天盖地的宣传下,已经有不少人或花钱找人上门安装、或自己琢磨教程,最终成功“养虾”。

将OpenClaw、QClaw等各式各样的“龙虾”部署到电脑里还只是万里长征的第一步,让它来帮忙干活才是大家想要的。然而对于习惯使用豆包、千问、元宝等免费AI产品的普通用户来说,“龙虾”持续运行需要消耗的Token成为了前所未有的挑战。

偏偏这股龙虾热催生的海量Token需求让各大云服务提供商看到了商机,Token的价格开始一路上涨。这时候寻求低价Token就成了不少人的刚需,如今在淘宝、闲鱼等主流电商平台就有相当多第三方号称廉价的Token资源销售,也就是所谓的“第三方AI中转站”。

这类第三方AI中转站的Token往往比Kimi、智谱、DeepSeek的官方价格便宜一半以上,看起来相当有竞争力。然而世界上没有天上掉馅饼的好事,第三方AI中转站的Token很烫手。

日前,来自加州大学圣芭芭拉分校和圣地亚哥分校的研究团队发现,市面上的第三方AI中转站安全性堪忧。

该团队对来源于淘宝、闲鱼、Shopee等电商平台的28个付费AI中转站进行了全面评测,结果让人大跌眼镜,其中1个站点会在响应中主动注入恶意代码、并部署自适应规避触发器,有17个中转站触碰了他们故意部署的诱饵凭证,还有1个中转站更是直接窃取了该团队放在“蜜罐”中的虚拟货币。

除此之外,这个团队还故意将API密钥泄露到公开论坛,结果相关密钥被立即使用,随后消耗了1亿Tokens。因此该研究团队将AI中转站认定为AI大模型供应链中最脆弱的环节之一。

那么问题就来了,为什么第三方AI中转站能轻而易举地作恶呢?

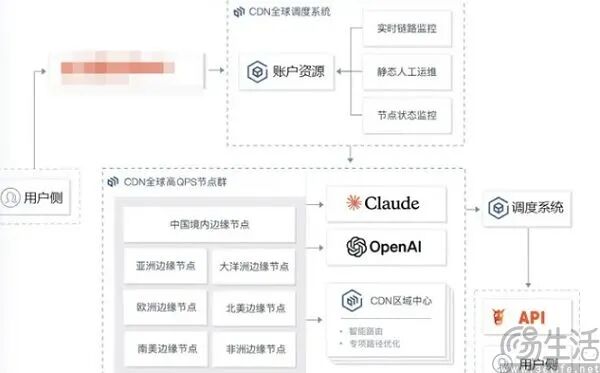

事实上,第三方AI中转站是介于用户与AI厂商官方服务之间的代理层,也可以将其理解为“Token代购”,它的商业逻辑就是“当中间商赚差价”。问题就出现在这里,第三方AI中转站卖的Token比原厂更便宜,靠的是企业级客户折扣、大额预付返利、教育/研究补贴额度,以及最为关键的多供应商混合调度。

不同AI模型的Token价格也不一样,例如Claude Opus这种顶级模型就很贵,它输出100万Token需要25美元,而DeepSeek V3.2就只要0.42美元。而多供应商混合调度的核心则是智能识别任务类型,将不同复杂度的请求路由到最合适的模型。换而言之,第三方AI中转站通过混合调度,让你有可能花着Claude Opus的价格,享受的却是DeepSeek V3.2的服务。

这种情况其实非常普遍,因为大部分“龙虾”干的活无外乎写文章、做PPT、生成图片、写代码,根本不需要旗舰模型出手,而绝大部分用户在使用的时候,也很难准确洞察到不同模型的智能水平。

如果只是“挂羊头卖狗肉”也就罢了,真正的威胁在于第三方AI中转站能看到你的所有请求。例如多供应商混合调度是有“代价”的,智能识别任务类型就意味着来自上游AI模型和下游用户的请求,它都有明文完全访问权。这时候无良的第三方AI中转站在上游的模型返回结果后偷偷篡改参数,就能实现任意代码执行(RCE)、持久化后门植入。

第三方AI中转站的运行模式决定了它要作恶几乎毫无门槛,即便AI厂商将防止提示词注入等安全防护做到极致,也防不住中间人的攻击。哪怕第三方AI中转站不搞直接违法的黑客行为,让用户平白无故多花钱也是易如反掌的事情。

以为第三方AI中转站的单价打了五折?Prompt Caching(提示词缓存)其实才是看不见的杀手。AI模型每次处理请求,都需要将完整的对话历史重新"读"一遍,为了降低用户的成本,AI厂商使用提示词缓存把已经读过的内容缓存下来,下次命中缓存的部分就会直接打一折。

可是第三方AI中转站由于会使用多账号轮换分配请求,这就代表你第一次请求在账号A即便建了缓存,第二次请求分到了账号 B上,此前的缓存就会直接作废,又要重建。如此一来,Token消耗岂有不起飞的理由。

简而言之,第三方AI中转站虽然确实是普通用户最高效、最低成本触达全球顶尖生产力的桥梁,可它的坑似乎更多。

【本文图片来自网络】