今天,机器人和自动化领域的全球顶级会议 ICRA 2025 在亚特兰大正式拉开帷幕。

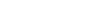

不久前,机器人领域的顶级赛事 —— ManiSkill-ViTac 2025 也公布了获奖团队名单。

5 月 23 日,ManiSkill-ViTac 2025 的成果将在 ICRA 2025 第六届 ViTac 国际研讨会中集中汇报。

据主办方统计,本届赛事吸引了来自清华、北大、港大、新加坡国立大学、穆罕默德・本・扎耶德人工智能大学等 42 支全球顶尖团队同台竞技。

最终包揽三个赛道金牌的赢家,是来自国内的两家具身初创公司。

其中,拿下「纯触觉操控」和「触觉传感器设计」两个赛道金牌的是原力灵机 Dexmal。

这家刚成立不久就获得 2 亿天使轮融资的黑马企业,核心团队出身于老牌 AI 企业旷视科技,并且具有超过 10 年的 AI 原生产品规模落地经验。

拿下「视触融合操控」赛道的冠军它石智航,几乎与原力灵机同时宣布了天使轮融资,凭借 1.2 亿美元的融资额创造了中国具身智能行业最大天使轮新纪录。

三大赛道,三块金牌,不仅让大家感受到了具身智能在细分领域有多「卷」,更是体现了中国在机器人操控领域的国际领先实力。

机器人界「奥赛」,视触觉融合大挑战

在人工智能的版图中,具身智能与 AI 1.0 时代和如今炙手可热的 LLM,有着本质的区别。

AI 1.0 聚焦于模式识别,大模型擅长处理文本等多元信息。

具身智能则直面物理世界,追求让机器人像人类一样感知、思考并与环境交互。

这种「身体与智能」的结合,不仅需要算法的突破,还要求硬件设计、场景适配和多模态感知的深度协同。

另外从衡量标准来说,不同于 AI 1.0 时代产学研在 CVPR 的华山论剑;也不同于大模型行业在 OpenCompass,Eval 等 Benchmark 上的百家争鸣。

具身领域的基准相对稀缺分散,且挑战重重。

它不仅需要模拟复杂的物理交互、开发高精度硬件,甚至在真实场景中验证算法的鲁棒性,这使得相关赛事的门槛极高,玩家数量也更少。

随着具身技术日趋成熟,竞争越来越激烈,其细分领域的挑战赛热度也在升温。

当前,公众往往更关注机器人的运动性能,比如灵活的机械臂或灵巧的步伐,但在实际应用中,视觉触觉等多模态感知的融合对机器人发展至关重要。

为了促进机器人获得像人类一样的操控技能,ManiSkill 基准测试应运而生。

自 2022 年首届于 ICLR 举办以来,ManiSkill 挑战赛已成为具身智能领域的「金字招牌」。并在 2024 年引入「视触觉」融合专题(Vitac),以弥补传统视觉主导方案的不足。

运动能力可以让机器人「动起来」,比如近来比较火的擎天柱热舞视频,而多模态感知则赋予其「看懂世界,摸清环境」的智慧。

尤其是,在需要精细操作的场景中,视觉触觉协同作用决定了机器人的使用价值。

然而,在许多现实场景中,它们的表现仍不如意。

比如,在抓取不规则物体、执行毫米级精度的操作,或处理柔性材料时,机器人常常因感知不足而失败。

英伟达高级科学家 Jim Fan 在红杉的闭门演讲中,将其称之为「物理图灵测试」。演讲过程中,他展示了一个机器人提供 VIP 早餐服务的翻车视频,引全场爆笑。

一个再普通不过的生活场景,机器人为啥就搞得一团糟呢?

这是因为,当前机器人领域的研究主要依赖视觉感知,通过摄像头捕捉环境信息,并进行决策。

但视觉主导的方案,在接触密集场景中存在着明显的局限性,比如遮挡、光线变化、物体透明度,都会干扰视觉数据。

与此同时,那些缺乏触觉反馈的机器人,更是难以感知接触力、表面纹理或物体刚性等关键信息。

这导致了,机器人在医疗手术、精密装配、复杂物流分拣等场景中,难以达到人类水平的操作能力。

ManiSkill-ViTac 视触觉融合挑战赛的诞生,恰恰填补了这一技术空白。

主页地址:https://ai-workshops.github.io/maniskill-vitac-challenge-2025/

它由清华、UCSD、伦敦国王学院等顶尖机构联合主办,聚焦于视触觉融合技术,以拓展机器人在复杂操作任务中的能力边界。

与历届 ManiSkill 赛事不同,ManiSkill-ViTac 提供了触觉物理仿真平台并搭建了现实世界的测试平台,是全球范围首个结合视觉与触觉的公开赛事。

ManiSkill-ViTac 2025 的意义远超学术竞赛,它为机器人行业提供了从实验室到现实应用的桥梁。

它将推动触觉 - 视觉融合算法的进步,加速改进触觉传感器设计,为丰富接触的操作任务建立基准。

在 42 支全球参赛团队中,中国团队的表现尤为亮眼。

以原力灵机为代表,不仅在算法研发上取得了突破,还通过「算法 + 硬件 + 场景」的系统创新,推动技术快速落地。

中国队夺三金,凭什么?

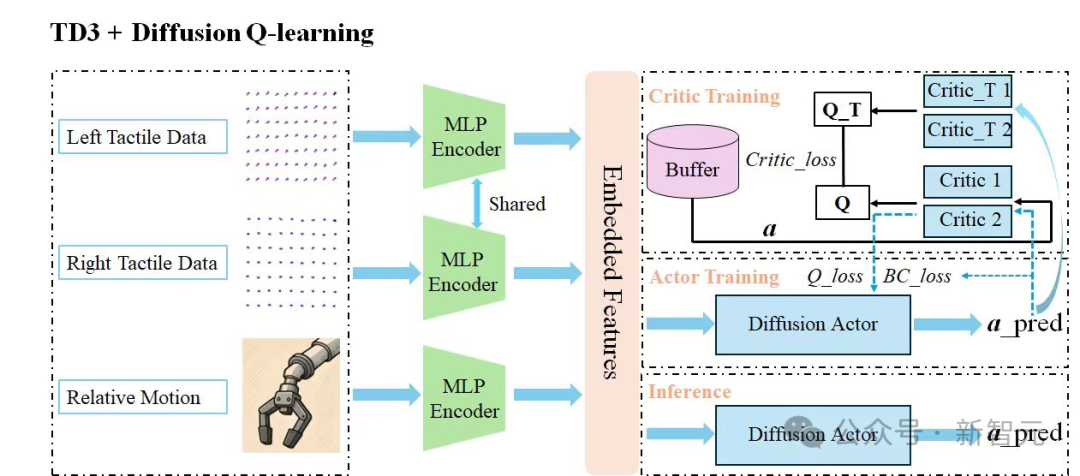

在纯触觉操作赛道(Track1)中,原力灵机 Dexmal 团队直面机器人操控的终极难题:

如何在完全没有视觉辅助的条件下,仅凭触觉完成高精度的操作?

根据介绍,Track1 要求机器人通过触觉传感器,完成将轴体插入毫米级孔洞的复杂任务。

这不仅需要其精准解析轴体轮廓的种种特征,还要依据接触反馈构建起准确的空间坐标系。

传统方案大多依赖 RL,但受限于触觉数据的低维度和高噪声,成功率仅为 14.81%,且因接触力失衡,传感器常因过度受力而损坏。

为此,Dexmal 团队提出了创新的「双范式学习框架」,将专家知识与智能学习巧妙结合。

首先,他们利用专家示范数据,对策略网络进行预训练,让机器人快速掌握空间探索的基本能力。

随后,团队引入模仿学习生成动态奖励函数,为 RL 的每一步微观操作提供精准、实时的反馈引导。

这种分层递进学习的策略,就像为机器人装上了双「无形的眼睛」,让其在无视觉辅助这一苛刻条件下,依然能够精准定位孔洞位置。

这一方案的真实效果,令人震撼。

在仿真测试中,Dexmal 混合算法将成功率提升了 2-3 倍,远超单一强化学习的方案。

更重要的是,在真实机器人验证环节,Dexmal 方案凭借大幅领先的比分,充分彰显了其在纯触觉赛道领域的强大竞争力。

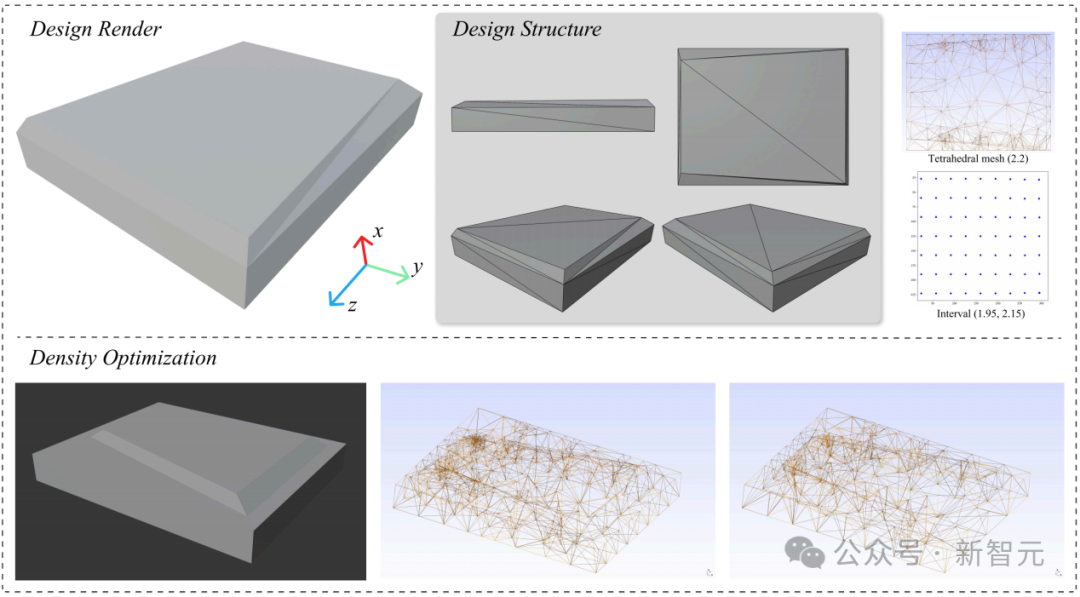

而在触觉传感器设计赛道(Track3)中,原力灵机 Dexmal 团队再次展现了技术前瞻性。

触觉传感器,作为机器人「触觉」的核心硬件,长期面临成本高、制造复杂、性能不稳定的难题,行业仍处于探索初期。

Dexmal 团队以经济性与高效性为核心目标,从传感器结构到数据处理进行了全链条优化。

首先,他们重新设计了传感器的几何形状,使其能自适应非均匀应力分布,轻松应对不同任务需求。

其次,团队优化了四面体网格,力求在计算精度与实时性之间达成平衡。

最后,他们优化了标记点的分布,兼顾空间分辨率与信号鲁棒性。

为了验证设计效果,团队对传感器的空间分辨率、计算效率和算法协同性进行了全面测试。

结果显示,新设计不仅让算法性能显著提升,还有效降低了成本。

这种「高性价比」的方案,让 Dexmal 团队在比赛中一举夺魁,或许将为触觉传感器的规模化应用打开了大门。

通往 AGI,必须要翻越具身的高山

与语音、文本等模态不同的是,触觉信息就是物理世界的「原生数据」。它不仅对具身智能至关重要,更是实现 AGI 的关键一环。

触觉,可以让机器人能够感知物理纹理、力反馈、材料特性等,提供视觉无法捕捉的信息。它为机器人与现实世界的深度交互提供了可能。另一方面,视觉则可以为全局环境的理解提供支持。

两者的融合,不仅可以提升机器人对环境的感知鲁棒性,还为跨场景、跨任务的泛化能力奠定了基础。

作为赛事主办方代表,清华大学助理研究员陈睿博士表示:

多感知模态融合在机器人领域有非常大的应用价值。我们举办挑战赛的初衷是希望为业界提供一个平台,共同推进视触觉融合技术的进步。

未来,我们还计划扩展任务复杂性,比如纳入语言模态,推进视觉-触觉-语言多模态大模型发展。也希望能够有越来越多的优秀团队能够参与进来。

相比如火如荼的 LLM,机器人直接作用于物理世界,是 AGI 必须要翻越的高山,也是解决未来生产力难题的核心。

只有将触觉视觉无缝融合,才能提升机器人精细操作的能力。

前段时间,老黄在接受采访时表示,人形机器人将是一个价值 50 万亿美元的产业。当前,全球机器人市场正处于爆发前夜。

未来,它将为工业、医疗、物流等领域的智能化转型,注入全新动能。就是说,这一领域技术突破和落地,将为全世界带去的价值不可估量。

中国团队在赛事中的卓越表现,彰显了其在全球 AI 和机器人领域的引领地位。

夺得双金的 Dexmal 团队表示,团队日前还参加了 CVPR 2025 协作智能 Workshop 核心赛事之一 ——RoboTwin,并在第一轮仿真平台赛中斩获并列第一。

目前,他们正全力备战第二轮比赛,结果将于 6 月底公布。

这些连连战绩,无疑为中国在具身智能领域的全球影响力,再添浓墨重彩的一笔。

ManiSkill-ViTac 2025 的正式落幕,不仅是一场技术的巅峰对决,更是中国具身智能崛起的里程碑。

原力灵机和它石智航的耀眼表现,展现了中国团队在算法创新、硬件突破、场景落地的全栈实力。

他们用三枚金牌向世界证明:中国不仅是 AI 赛道上的追赶者,更是引领者。

参考资料:

https://ai-workshops.github.io/maniskill-vitac-challenge-2025/#Award

本文来自微信公众号:新智元(ID:AI_era),作者:桃子、好困,原标题《三金,又是中国队!全球机器人视触融合挑战赛揭榜》