这两天,要论最受关注的公司,莫过于甲骨文。

本周三最拉风的个股,甲骨文单日增长36%,市值飙升2510亿美元(约合人民币1.78万亿元),震撼了全球投资者。用一个形象的比喻,这相当于一夜长出了三个寒武纪的市值。

伴随着公司市值的爆发,甲骨文联合创始人拉里・埃里森(Larry Ellison)的财富也水涨船高。据彭博亿万富豪指数显示,他的身家一度达到 3930 亿美元,短暂超越马斯克,登顶全球首富。

不过,暴涨之后市场出现了理性回调,周四收盘时,甲骨文股价下跌逾6%。但不管怎么说,此次甲骨文股价与市值的剧烈波动,已然成为全球市场关注的焦点,而推动这一切的 “核心动力”,主要源于两大原因:

一是巨额的订单。未实现履约义务(RPO)达4550亿美元,同比激增359%,短短3个月内激增3倍。要知道在今年5月底,公司报告的RPO仅为1380亿美元。不仅如此,公司还明确表示,仍有更多 “数十亿美元大单” 正在洽谈中,预计很快就能将 RPO 推过 5000 亿美元大关。

二是云业务预期的暴增。作为公司未来的核心增长引擎,甲骨文的云基础设施业务被寄予厚望:预计2026财年云基础设施收入增长77%至180亿美元,未来四年将进一步增至1440亿美元,增长8倍。

不少市场人士狂热呐喊:“下一个英伟达来了”。

踩中AI算力最大风口

甲骨文的爆发,核心在于其深度绑定了当下最火热的云服务与AI 服务赛道。

甲骨文2026财年第一财季的业绩增长,特别是RPO的显著提升,被视为在手订单“海啸级”大超预期,算力需求的能见度直抵2030年。第一财季,公司总营收为149亿美元,同比增长12%;非GAAP下的净利润为43亿美元,同比增长8%。

不过,其本季度业绩的重点并非单个季度的营收表现,而是积压订单的显著增长。

甲骨文在第一财季与三家不同客户签署了四份价值数十亿美元的合同,这使得RPO合同积压增长359%,达4550亿美元。未来几个月,甲骨文预计将再签下数家价值量达数十亿美元的客户,RPO极有可能突破5000亿美元大关。

这一数据背后,是全球巨头对AI 算力服务的疯狂抢购。换句话说,未来几年,仅甲骨文一家,就可能采购成千上万张 GPU、AI 芯片、光模块等算力相关硬件,而其 “双供应商战略”(左手英伟达,右手 AMD),更是将这一布局推向极致。

甲骨文的芯片战略走的是双供应商战略:左手英伟达,右手AMD。

英伟达阵营

目前,甲骨文的云基础设施中,大多数GPU仍由英伟达提供。其独树一帜的优势在于,会提供英伟达GPU的“裸机”实例。这让客户能够独家直接访问A10、A100、H100、H200 以及旗舰Blackwell芯片,无需承担虚拟化带来的性能损耗。

在超级AI项目布局上,甲骨文更是手笔惊人:计划推进代号 “星门” 的项目,部署6.4 万块英伟达 GB200 GPU组成液冷集群;更庞大的OCI Supercluster 液冷算力集群,将集成13.1 万颗 Blackwell GPU,整体AI 性能可达 2.4 ZettaFLOPS,相当于 3 倍于美国Frontier超级计算机的算力。

AMD 阵营

AMD的阵营里,甲骨文同样下了重注:2025年3月签署的数十亿美元协议,计划构建包含3万块AMD MI355X GPU的AI集群,这也是AMD迄今为止最大规模的云基础设施订单。

AMD MI355X GPU对标英伟达 Blackwell 系列的旗舰产品,其中英伟达Blackwell B200 的FP4性能为9 PFlops,内存192GB,带宽 8TB/s;MI355X虽在浮点性能上与B200接近,但在内存容量上更具优势。

甲骨文董事长兼CTO拉里・埃里森在2025财年第三财季电话会议上解释了选择AMD的原因:“我们能打造比对手更快、更经济的巨型AI集群。按小时计费模式下,速度优势直接转化为成本优势。”

为支撑这两大阵营的算力布局,甲骨文2026财年资本支出计划高达350亿美元,较2025财年激增65%,所有资金均投向芯片采购与数据中心扩建。

AI推理,算力耗尽

算力的需求似乎从来没有被真正满足过。只不过,需求结构已经从训练为主,迅速向推理为主迁移。

在甲骨文首席执行官Safra Catz看来,目前AI推理市场的规模将远超AI训练市场,而市场上的推理算力正被耗尽。在此背景下,甲骨文凭借在企业数据库领域的领导地位,使企业客户能在保障数据私密性的前提下,安全地结合私有数据与公有数据,利用大语言模型进行推理。

英伟达似乎也意识到了这个问题,最新的GPU——Rubin CPX,真是专门为大规模上下文推理而设计的全新GPU。性能是Vera Rubin NVL144平台的2倍多,是基于Blackwell Ultra的GB300 NVL72机架式系统的7.5倍。

GPU和ASIC,成为硬通货

如今,GPU和ASIC已成为AI时代的“硬通货”。

几乎所有硅谷巨头都在财报会议中透露,供给的短缺限制了自己收入增长。目前,谷歌云拥有1060亿美元待履行订单,待履行订单的增长速度,甚至超过了收入增长;亚马逊AWS云约1950亿美元;微软没有单独披露云服务的,它的整体商业待履行订单约3680亿美元。

据预测,到2026财年,微软、谷歌、Meta、亚马逊中的任何一家,资本开支都将超过 1000 亿美元。AI算力竞争属于“增量竞争”,但GPU产能却陷入“存量博弈”,这也导致 GPU 缺货问题持续发酵——尽管英伟达曾出面澄清相关传闻。

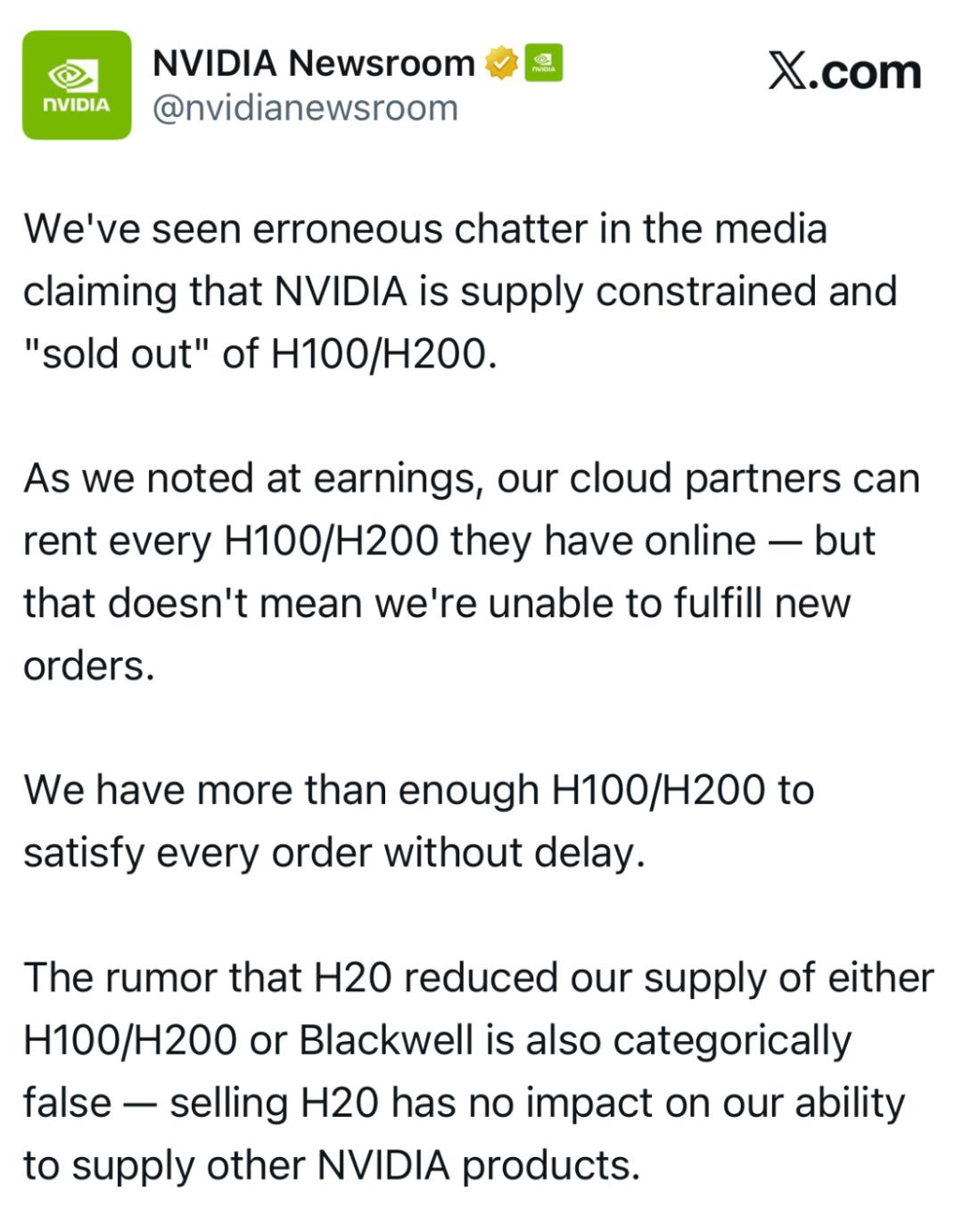

9月2日,英伟达官方社交媒体账号发推文,否认H100和H200 GPU供应不足的说法,称“基于Hopper架构的AI芯片供应充足,足以立即满足需求”,并表示“云合作伙伴可租用在线拥有的每一块H100/H200,新订单能毫无延误地完成”,同时驳斥“H20 导致 H100/H200或Blackwell 供应减少”的传言。

但此前在财报业绩电话会上,英伟达CEO 黄仁勋曾明确表示:“H100 售罄了,H200 售罄了。大型云服务供应商(CSP)正在从其他云服务商那里租用容量,AI 原生初创公司也在争相获取容量以开展模型训练与推理,需求真的非常高。”

GPU的供应瓶颈,也催生了ASIC的崛起。巨头们希望通过ASIC芯片,将自身的算力份额从与英伟达GPU的强绑定中解放出来,实现差异化竞争:

AWS的Trainium2在同等预算下完成推理任务的速度比英伟达H100更快,性价比提升30%到40%;

谷歌第七代TPU Ironwood支持10MW级液冷机柜,FP8算力超越英伟达最新的B200芯片;

Meta的MTIA系列ASIC计划采用170kW高功率液冷机架,专为短视频推荐算法优化。

市场数据显示,2024年全球ASIC芯片市场规模约达120亿美元,预计2024-2027年间将保持高增长率,到2027年有望突破300亿美元,年复合增长率达 34%。

“卖铲人”效应

甲骨文的暴涨并非个例,上一个经历如此夸张股价上涨的企业,是博通。

尽管博通定位与甲骨文不太一致,但都能够将其归类为“AI时代的卖铲人”。在过去两年,博通股价飙升了261%,成为全球第七大市值公司,市值达到1.4万亿美元,也是全球第二大半导体公司,仅次于英伟达,领先于台积电。

博通最新的业绩表明,公司营收达159.6亿美元,同比增长22%,创历史同期新高;净利润41.4亿美元,同比扭亏为盈;自由现金流激增47%至70亿美元。其中,AI芯片业务表现尤为亮眼:收入同比增长63%至52亿美元,占半导体解决方案业务收入的57%。公司预计,第四财季AI芯片收入将加速增长至62亿美元,环比增长19%,全年AI业务收入占比有望突破40%。

博通也同时宣布了新的合作,陈福阳则表示,上个季度,一个新的潜在客户下了确定的订单,真正成了博通的客户。博通从新客户获得超100亿美元的人工智能芯片订单。据业内推测,这个新客户很可能是Open AI。

结语

“最终,AI将改变一切。”拉里·埃里森表示。

甲骨文的股价狂欢与博通的崛起,皆是AI 算力热潮催生的“卖铲人”奇迹。当全球巨头争抢算力、订单与芯片,当算力需求从训练转向推理、GPU 与 ASIC 成硬通货,不难看出AI产业的竞争早已聚焦于算力基础设施。

热潮之下,机遇与隐忧并存,分析师也提出了相关质疑。

摩根大通在10日的研报中表示,市场可能忽略了几个核心问题:包括客户集中度风险,大部分收入可能要在遥远的未来才能得到确认,新增的大部分订单与AI模型训练有关,这类业务的利润率相对较低,以及甲骨文是否有足够的资金为巨额订单进行天文数字般的基础设施建设仍然存疑。这些问题,都是甲骨文需要直面的挑战。

AI 改变一切的进程已然开启,算力作为核心基石的价值毋庸置疑。但对于甲骨文们而言,想要真正接住AI浪潮的红利,不仅需要持续加码算力布局,更需在盈利可持续性、风险防控等层面拿出切实答案。