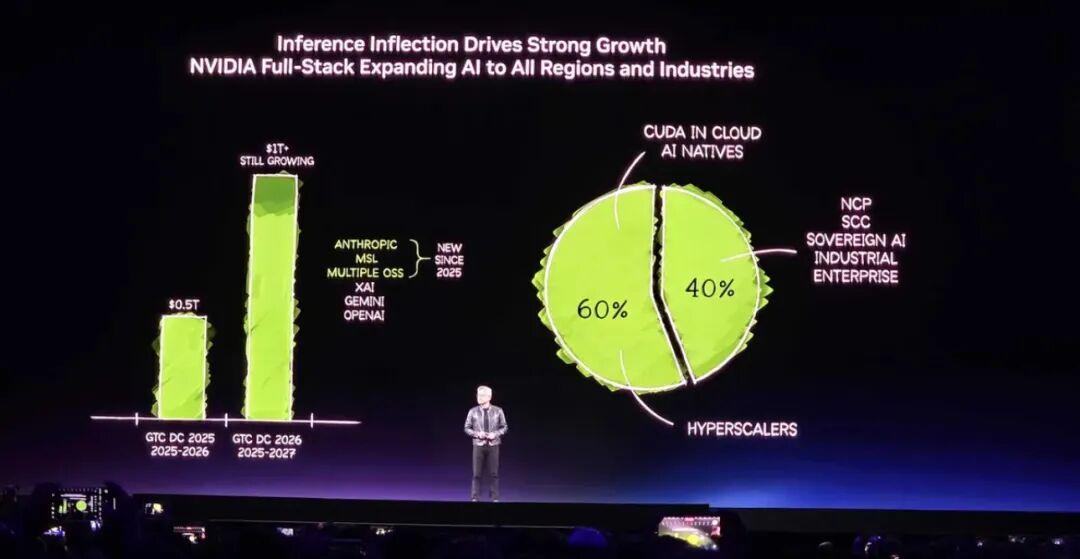

英伟达首席执行官黄仁勋周一举办的GTC 2026上详细阐述了他保持公司在人工智能热潮中处于领先地位的愿景,他预测人工智能热潮将在未来一年内产生价值 1 万亿美元的订单积压。

黄身穿标志性的黑色皮夹克,在 加利福尼亚州圣何塞 座无虚席的体育馆里的舞台上漫步了两个多小时。 他解释了英伟达的处理器如何成为不可或缺的人工智能组件,并重点介绍了他认为将使公司保持领先地位的产品。

现年 63 岁的黄仁勋还谈到了他近年来作为硅谷最具影响力的人物之一所一直宣扬的许多主题,包括他认为人工智能的发展仍处于起步阶段的论点。

黄仁勋宣称:“我们重新定义了计算,就像个人电脑革命和互联网革命一样。我们现在正处于一个全新平台变革的开端。”

为了强调自己的观点,黄仁勋预测,到今年年底,英伟达的芯片订单积压额将达到 1 万亿美元,是去年同期预测的两倍。

为了迎接这个机会,他们在会上发布了多颗芯片和系统。

Nvidia Groq 3 LPU 正式亮相

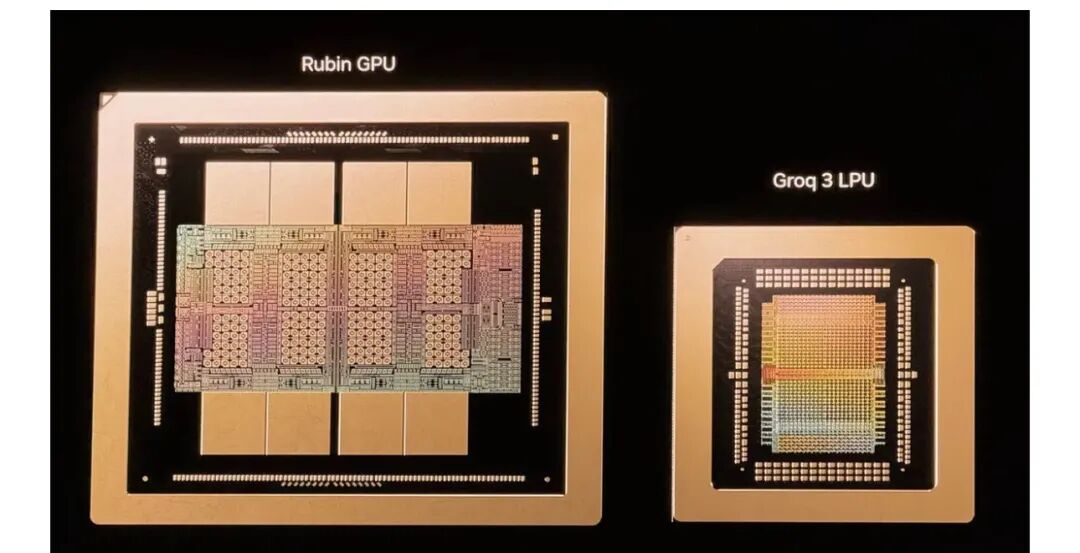

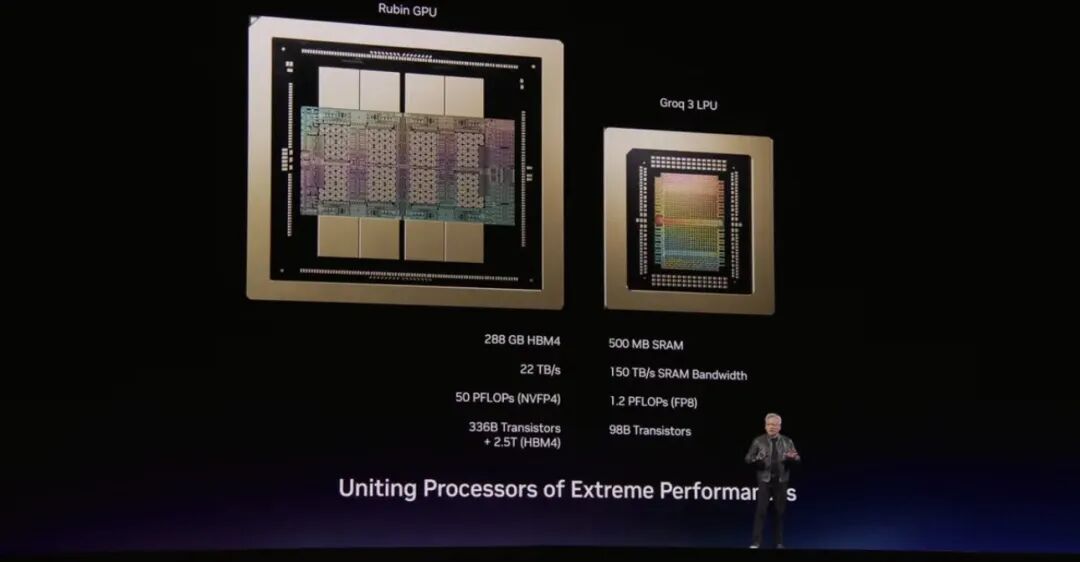

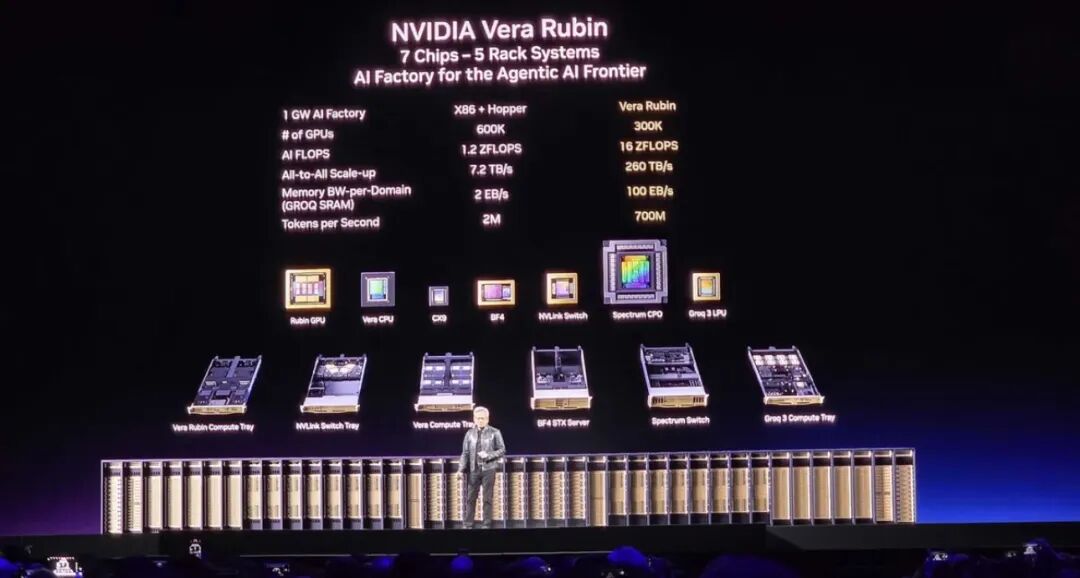

在 今天的GTC 主题演讲中,黄仁勋透露了英伟达如何利用去年从 Groq 收购的知识产权来扩展 Rubin 的功能。Rubin 平台现在包含一款新的芯片——英伟达 Groq 3 LPU,这是一款推理加速器,能够增强这些系统以低延迟、大批量的方式交付令牌的能力,从而在人工智能模型的前沿实现高交互性。

与大多数依赖 HBM 作为工作内存层的 AI 加速器不同,每个 Groq 3 LPU 都集成了 500 MB 的 SRAM,这种内存也用于 CPU 和 GPU 的超高速缓存。虽然与每个 Rubin GPU 上容量高达 288GB 的 HBM4 相比,这显得微不足道,但正如您所预期的,这块 SRAM 可提供 150 TB/s 的带宽,远高于 HBM 的 22 TB/s。对于带宽敏感型 AI 解码操作而言,Groq 3 芯片带宽的大幅提升为推理应用带来了诱人的优势。

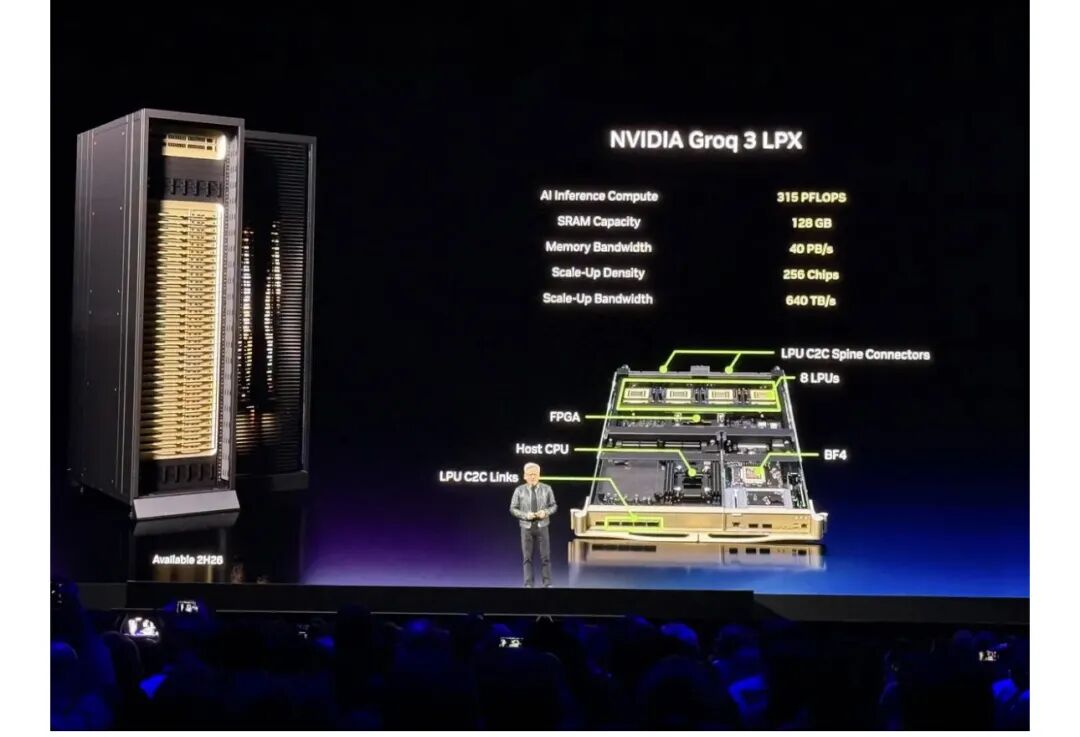

反过来,英伟达将构建包含 256 个 Groq 3 LPU 的 Groq 3 LPX 机架。该机架提供 128GB 的 SRAM 和 40 PB/s 的推理加速带宽,并通过每个机架 640 TB/s 的专用扩展接口将这些芯片连接起来。

英伟达将 Groq LPX 设想为 Rubin 的协处理器,据英伟达超大规模副总裁 Ian Buck 称,它将提升“每个令牌上 AI 模型每一层”的解码性能,并使 Rubin 能够服务于人工智能的下一个前沿领域:多智能体系统,这些系统需要在推理数万亿个参数的模型的同时,在数百万个token的上下文窗口中提供交互式性能。

随着多智能体系统中的人工智能代理越来越多地与其他人工智能进行交互,而非与查看聊天机器人窗口的人类进行交流,对响应速度的要求也随之改变。对人类而言看似合理的每秒token生成速率,对人工智能代理来说却如同蜗牛爬行。在巴克所描述的未来多智能体系统中,Rubin GPU 和 Groq LPU 的组合将人工智能代理间通信的吞吐量从每秒 100 个token提升到每秒 1500 个token甚至更高。

Rubin平台新增Groq 3 LPU,有望帮助其在低延迟推理领域抵御挑战者。Cerebras公司凭借其晶圆级引擎,融合海量SRAM和计算资源,利用先进模型实现低延迟推理,该公司曾多次就Nvidia GPU在这方面的劣势向Nvidia发起挑战。包括OpenAI在内的众多大型客户已签约使用Cerebras的计算能力,以利用该平台优异的延迟特性来运行其部分尖端模型。

Buck 还暗示,Groq 3 LPU 的推出可能会导致 Rubin CPX 推理加速器的作用降低,他表示公司目前专注于将 Groq 3 LPX 机架与 Rubin 集成。虽然他没有透露更多细节,但在如今内存资源紧张的环境下,这种重心转移是合理的,因为这两款芯片旨在提供类似的推理性能提升,而且 Groq LPU 不需要像每个 Rubin CPX 模块那样大量的 GDDR7 内存。

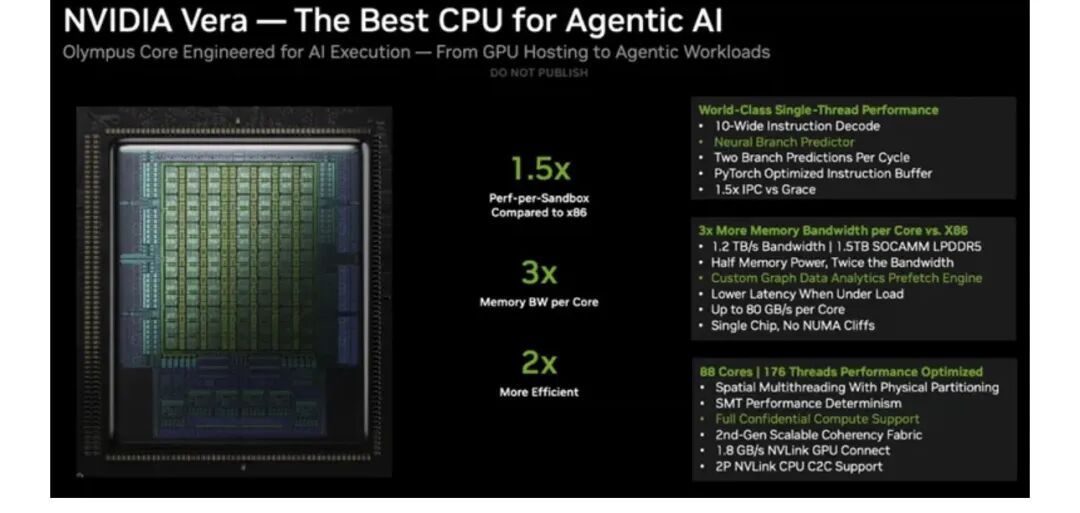

全新88核Vera CPU叫板AMD/Intel

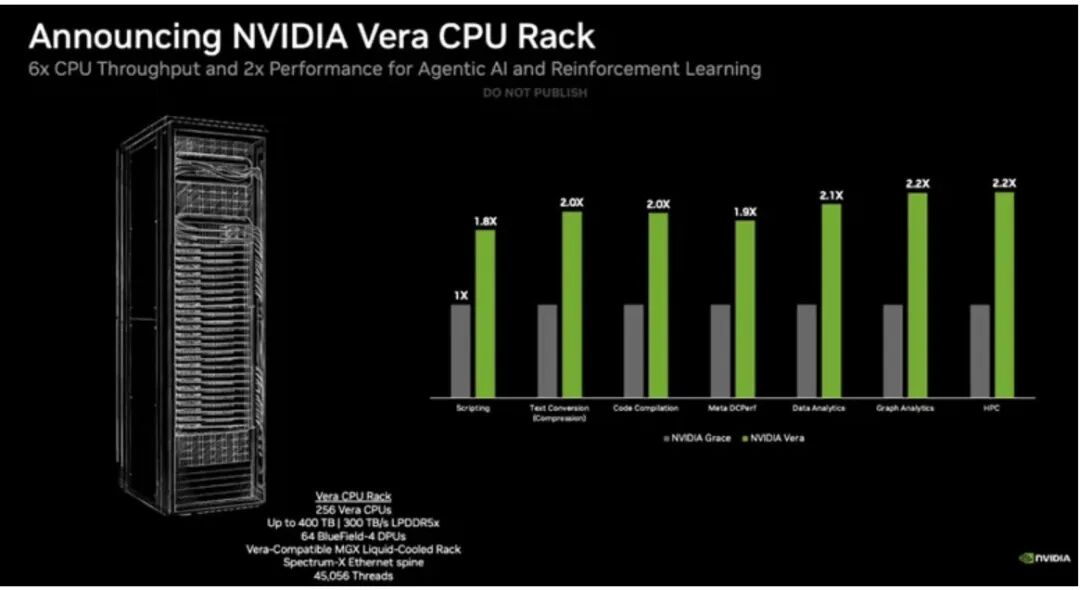

在 GTC 2026 大会上,英伟达公布了其全新 88 核 Vera 数据中心 CPU 的更多细节,声称其性能比标准 CPU 提升了 50%,这得益于 Olympus 核心 IPC 提升 1.5 倍,以及英伟达所称的创新高带宽设计,该设计可提供市场上最快的单线程性能。该公司还发布了全新的 Vera CPU 机架架构,该架构将 256 个液冷 CPU 集成到一个机架中,专为以 CPU 为中心的工作负载而设计,据称其 CPU 吞吐量提升了 6 倍,在智能 AI 工作负载中的性能提升了 2 倍。

Vera CPU 的演进及其与可部署机架级系统的集成,标志着英伟达正式进军 CPU 直销领域,成为传统 CPU 市场中英特尔和 AMD 的有力竞争对手。更不用说,它还要与全球最大的超大规模数据中心运营商使用的各种定制 Arm 处理器展开竞争。此前,英伟达宣布Meta 将在其基础设施中部署多代英伟达纯 CPU 系统,因此这一举措并不令人意外。英伟达还将继续在其以 GPU 为中心的系统中使用这些 CPU,例如我们此前深入报道过的 Vera Rubin 平台。

英伟达最初于 2022 年 GTC 大会上发布了第一代 Grace CPU,预示着该系列的持续发展最终将使其跻身更广泛的 CPU 市场。新款处理器面向人工智能和通用应用场景,尤其侧重于前者。英伟达不断拓展其功能和目标市场,这将对 AMD 和英特尔在人工智能数据中心的插槽争夺战构成严峻挑战。这些芯片现已全面投产,并将于今年下半年提供给英伟达的合作伙伴。接下来,我们将详细了解这些新芯片及其机架级架构。

Nvidia 设计 Vera CPU 的目的是为了融合多方面的优势,将超大规模云 CPU 的高核心数、游戏 CPU 的高单线程性能和移动芯片的能效相结合,从而加速智能 AI、训练和推理工作负载中常见的 GPU 驱动任务,例如 Python 执行、SQL 查询和代码编译。

总而言之,英伟达声称其沙箱性能比 x86 竞争对手高出 1.5 倍,每个核心的内存带宽高出 3 倍,能效高出两倍。为了实现这些目标,该公司设计了一款 88 核 144 线程的 CPU,比第一代 Grace 的 72 核有所增加。英伟达还声称,这些核心的每周期指令数 (IPC) 吞吐量提高了 1.5 倍,相对于其他竞争架构而言,这是一个巨大的代际飞跃,因为其他竞争架构通常每一代只有个位数或十几个百分点的提升。在上一代 Grace 中,英伟达使用了现成的 Arm Neoverse 核心,但该公司明确指出 Vera 上的全新 Olympus 核心是“英伟达设计的”,这表明该公司对参考设计进行了定制修改。

Arm v9.2-A Olympus 内核采用空间多线程技术,通过避免对执行单元、缓存和寄存器文件等关键元素进行时间片轮换,从而在物理上隔离流水线的各个组件。这与其它同步多线程 (SMT) 实现中常见的标准时间片轮换机制截然不同,后者是指线程轮流使用资源。空间多线程通过在执行单元空闲时从其他线程拉取指令,从而提高指令级并行性 (ILP)、吞吐量和性能可预测性,确保资源得到充分利用。

实际上,这使得两个线程能够真正地在单个核心上同时运行,而标准的SMT实现中,线程实际上是轮流在单个核心上运行的。这自然对多租户环境来说是一大优势。

英伟达将所有 88 个核心排列在一个域中,因此不存在 NUMA 架构中常见的延迟问题,这与目前高核心数的 x86 竞争对手形成了鲜明对比。这显著提升了延迟、可预测性、带宽和可编程性。该公司尚未透露如何在保持每个核心足够延迟的情况下实现这一壮举的全部细节,但该芯片采用了新一代英伟达可扩展一致性架构 (SCF),这是一种基于 Arm CMN-700 一致性网状网络的网状拓扑结构,该网络也用于Grace 的 Arm Neoverse 核心。Arm 在其最新设计中已升级到更新的 Neoverse CMN S3 网状网络,Vera 很可能采用了该设计或其变体。

网状网络能够为所有核心提供令人印象深刻的内存吞吐量,尤其是在某些核心比其他核心更需要带宽的情况下。Grace 架构支持 546 GB/s 的网状内存吞吐量,平均每个核心 7.6 GB/s。Vera 架构在此基础上翻了一番,带宽达到 1.2 TB/s,这得益于 1.5TB SOCAMM LPPDDR5 内存模块(容量提升 3 倍),在满载情况下,平均每个核心可达 13.6 GB/s。更重要的是,当网状网络中的负载情况不一致时,该架构现在支持单个核心最高 80 GB/s 的吞吐量,这对带宽密集型线程来说是一个显著的提升。

执行路径包括一个 10 宽的指令解码单元、一个支持每个周期进行两次分支预测的神经分支预测器、一个自定义的图数据库分析预取引擎和一个 PyTorch 优化的指令缓冲区。

该芯片全面支持机密计算,相比 Grace 芯片,这是一项显著的进步,可实现完全保护的 CPU+GPU 域。该 CPU 还配备了 NVLink-C2C 芯片间接口,吞吐量高达 1.8 TB/s,是 Grace 芯片 900 GB/s 互连速度的两倍,比 PCIe 6.0 快七倍。此外,它还支持双处理器 (2P) 配置。

总体而言,Vera 支持现代数据中心处理器所期望的全套技术,包括 PCIe 6.0 和 CXL 3.1 支持,但其计算设计以带宽和延迟为重点,使其在 AI 工作流程中具有独特的优势。

Grace 已成为许多英伟达 GPU+CPU 系统的基本构建模块,包括一些地球上速度最快的 AI 超级计算机,但英伟达的扩展目标是利用 Vera 在纯 CPU 机架中实现更广泛的部署。

Vera CPU 机架通过 256 个液冷 Vera CPU、74 个 Bluefield-4 DPU 和 ConnectX SuperNIC 网络来实现这一目标。该机架配备高达 400 TB 的 LPDDR5 内存,总内存吞吐量达 300 TB/s。这足以支持 45,056 个线程,据 Nvidia 称,这些线程可同时支持 22,500 个独立运行的 CPU 环境。

Nvidia 分享了各种工作负载的基准测试结果,声称在脚本编写、编译、数据分析、图分析和 HPC 工作负载等方面,其性能比 Grace 提高了 1.8 倍到 2.2 倍。

人们自然会认为这套系统会部署在 Meta 公司,该公司最近宣布与英伟达合作开发纯 CPU 系统,但英伟达表示,它还将向包括 Oracle、Coreweave、Nebius、阿里巴巴等在内的超大规模数据中心运营商提供 Vera CPU 机架系统。

众多OEM和ODM厂商也将为更广泛的市场提供单路和双路服务器,以满足各种应用场景的需求,其中包括戴尔、HPE、联想、超微、富士康等行业巨头。Vera CPU也将用于Nvidia HGX NVL8系统。

或许最重要的是,这些机架还将成为英伟达更广泛的 Vera Rubin 平台的组成部分,该平台总共包含七款芯片,包括 Rubin GPU、用于机架级互连的 NVLink6 交换机、用于网络连接的 ConnectX-9 SuperNIC、Bluefield 4 DPU、Spectrum-X 102.4T 共封装光交换机和英伟达的 Groq 3 LPU。

Vera CPU 目前已全面投产,预计将于今年下半年开始交付。

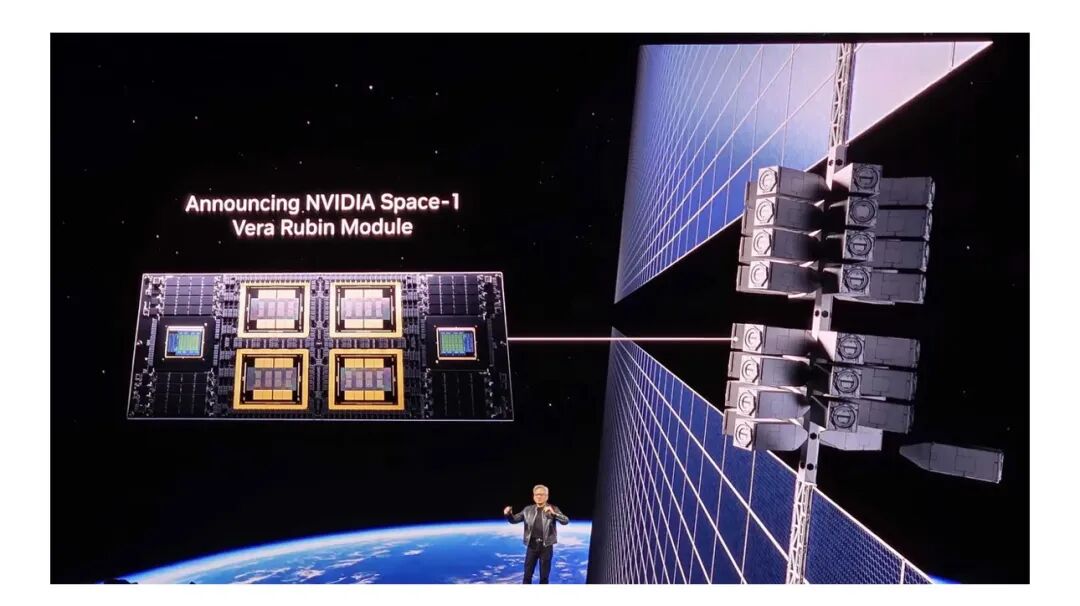

发布 Vera Rubin 太空模块

在GTC 2026大会上,英伟达还发布了Vera Rubin太空模块,声称其在轨道推理工作负载方面的AI计算能力是H100的25倍。据悉,已有六家商业航天公司部署了该平台。

根据英伟达官方新闻稿,Vera Rubin 空间模块专为在太空直接运行 LLM 和高级基础模型的轨道数据中心而设计,它采用紧密集成的 CPU-GPU 架构和高带宽互连,旨在实时处理来自太空仪器的大量数据流。

其次是Nvidia IGX Thor,它面向任务关键型边缘环境,支持实时AI处理、功能安全、安全启动和自主运行。与此同时,Nvidia Jetson Orin则采用最小尺寸设计,面向对尺寸、重量和功耗(SWaP)有严格限制的卫星,用于机载视觉、导航和传感器数据处理。

回到地球上,Nvidia 将RTX PRO 6000 Blackwell系列服务器版 GPU 定位为地理空间智能工作负载,声称在分析大型图像存档时,其性能比传统的基于 CPU 的批处理系统提升高达 100 倍。

英伟达表示,目前有六家公司正在轨道和地面环境中使用其平台:Aetherflux、Axiom Space、Kepler Communications、Planet Labs PBC、Sophia Space 和 Starcloud。其中,Kepler 已在其卫星星座中部署了 Jetson Orin,用于人工智能驱动的数据管理。“英伟达 Jetson Orin 将先进的人工智能直接引入我们的卫星,使我们能够智能地管理和路由整个星座的数据,”该公司首席执行官 Mina Mitry 在英伟达的官方新闻稿中表示。

去年十月,亚马逊和蓝色起源创始人杰夫·贝佐斯预测,轨道上千兆瓦级数据中心还需要10到20年才能建成,他认为持续的太阳能发电和太空简化的冷却环境是其主要优势。英伟达的六家合作伙伴之一Starcloud已经在建设其所谓的专用轨道数据中心,旨在运行轨道上的训练和推理工作负载。

“太空计算,最后的疆界,已经到来,”黄仁勋说道,“人工智能在太空和地面系统中的处理,能够实现实时感知、决策和自主性,将轨道数据中心转变为发现的工具,将航天器转变为自主导航系统。”

IGX Thor、Jetson Orin 和 RTX PRO 6000 Blackwell 服务器版现已上市。Vera Rubin 太空模块尚未公布发布日期;英伟达表示将在“稍后”推出。

随着这颗芯片的发布,Vera Rubin 成为英伟达迄今为止最具雄心的系统,它由五个机架系统中的七颗芯片组成。英伟达表示,与 x86 和 Hopper 相比,Vera Rubin 每秒可处理 7 亿个token,而后者仅为 200 万个。

英伟达的推理芯片危机

英伟达凭借其在人工智能芯片市场的主导地位,将其年收入从 2022 年的 270 亿美元增长到去年的 2160 亿美元——这一增长率使这家位于加利福尼亚州圣克拉拉的公司的市值达到了 4.5 万亿美元。

但自去年 10 月英伟达市值短暂突破 5 万亿美元大关以来,该公司一度火热的股价已经降温,原因是人们担心人工智能的热潮被过分夸大了。

“对于科技行业来说,这真是一段令人胆战心惊的时期,”韦德布什证券分析师丹·艾夫斯表示。

即使英伟达在 2 月下旬发布的季度报告远超分析师预期,且管理层也给出了乐观的展望,但该公司股价仍比这些数据公布前下跌了 6%。

尽管分析师预计英伟达明年的收入将超过 3300 亿美元,但随着谷歌和 Facebook 的母公司 Meta Platforms 等其他科技巨头试图开发自己的处理器,该公司在人工智能芯片市场正面临着第一个严峻的挑战。

英伟达的潜在增长受到美国安全和贸易壁垒的制约,这些壁垒阻碍了该公司在中国销售其先进芯片的能力。

黄仁勋设想,英伟达将继续在人工智能领域发挥重要作用,通过持续满足市场对驱动聊天机器人(如 OpenAI 的 ChatGPT 和谷歌的 Gemini)的芯片的狂热需求,并扩大其在推理处理器新兴市场的影响力。

一旦人工智能工具经过训练,推理芯片就能让这项技术运用所学到的知识并产生响应——无论是编写文档还是创建图像——其效率都比构建大型语言模型时使用的处理器更高。

英伟达首席执行官黄仁勋一直以来都宣称,2026年将是推理能力主导人工智能的一年。在3月4日的投资者大会上,他承认“我们现在看到的这种转折点其实早已显而易见,它本质上是人工智能使用文件、访问文件和使用工具的能力。”

“推理转折点已经到来,”黄仁勋强调。

英伟达目前面临的挑战是,其畅销产品在推理计算方面的吸引力远不如在训练计算方面。用户反映,其Grace Blackwell服务器能耗巨大,且内存不足,无法让AI模型快速高效地回答用户查询。

“英伟达现在处境很尴尬,”风险投资家、麻省理工学院数字经济计划研究员保罗·凯德罗斯基表示。“很长一段时间以来,詹森一直说,‘我们不需要专用的独立推理芯片,直接用Blackwell就行了。’但现在情况已经不同了,而且涌现出了很多新的竞争对手。”

凯德罗斯基认为,英伟达最近一个季度的毛利率高达73%,但由于两个原因,其毛利率必然会下降。首先,推理计算的商业模式非常重视效率和降低最终产品的生产成本,而对于消费者而言,最终产品指的是人工智能工具。其背后的硬件成本不能太高,否则无论是直接销售还是作为中间商销售的公司都无法盈利。

其次,由于更多芯片公司找到了降低芯片购买和运营成本的方法,推理计算领域的竞争也更加激烈。英伟达凭借其硅芯片(相当于速度快、性能强、价格昂贵的法拉利跑车)成为首家市值4万亿美元的公司,但如今,世界需要的是普锐斯和特斯拉Model Y这样的“家用轿车”。

“所有这些推理方面的东西对詹森来说都极具威胁,因为这一切都是以效率为导向的,”凯德罗斯基说。“他正拼命想办法将这个系列拓展到推理领域。”

于是,为了帮助其顺利过渡到推理领域,英伟达与市场专家 Groq 达成了一项数十亿美元的授权协议,其中包括聘用该初创公司的顶尖工程师。

“英伟达不会将任何市场份额让给谷歌或Meta,”艾夫斯说道,他认为英伟达的市值将在未来一年左右超过6万亿美元。

GPU不再是唯一主角

此外,还有其他迹象表明,英伟达正在将其重心从GPU转向推理计算解决方案提供商。今年2月,Meta Platforms宣布将在其人工智能数据中心部署数千颗英伟达Vera CPU,这是英伟达人工智能系统首次大规模部署,且未使用GPU。人们越来越认识到,推理计算可以使用CPU完成,并不一定需要英伟达的旗舰芯片。

据《华尔街日报》报道,英伟达也计划推出新的计算解决方案,该方案将采用多个独立于GPU的CPU,类似于Meta的计划。英特尔也计划推出类似解决方案。

顺便提一下,英特尔今天在圣何塞举行的Nvidia GTC 2026 大会上宣布,其 Xeon 6 处理器将作为 Nvidia DGX Rubin NVL8 系统的主机 CPU,从而扩展了两家公司此前在基于 DGX B300 Blackwell 的平台上使用Xeon 6776P建立的 x86 合作关系。

DGX Rubin NVL8 是英伟达的下一代旗舰级 AI 服务器系统。在该配置中,主机 CPU 负责任务编排、内存管理、调度以及向 GPU 加速器传输数据。随着推理工作负载向智能体 AI 和推理系统转变,这些功能对单核性能和内存带宽的要求越来越高。

回到GTC主题演讲,黄仁勋将英伟达描述为“垂直整合但横向开放”,这或许会引起美国联邦贸易委员会的关注。无论如何,英伟达表示,鉴于其在加速计算领域的目标——向客户提供完整的技术栈——“别无他法”。与此同时,他还将英伟达描述为“垂直整合但横向开放”,这或许会引起美国联邦贸易委员会的关注。无论如何,英伟达表示,鉴于其在加速计算领域的目标——向客户提供完整的技术栈——“别无他法”。

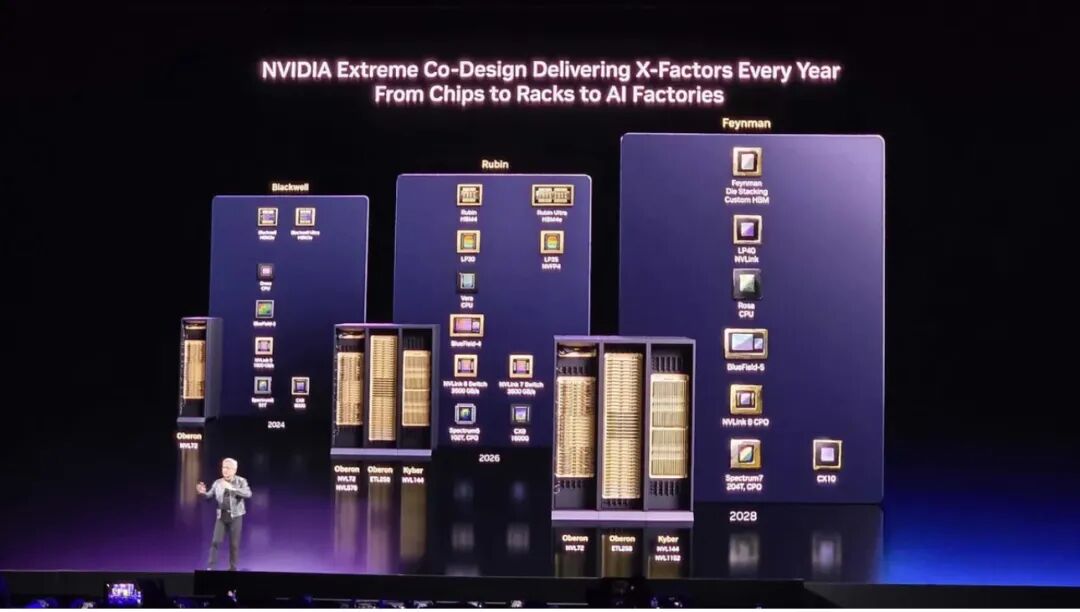

在这次大会上,黄仁勋再次预告了下一代Feynman系统。该系统配备了全新的GPU、LPU、名为Rosa的全新CPU、Bluefield 5以及Kyber架构,并支持铜缆和CPO扩展。Feynman系统预计将于2028年发布。

在推理迅速崛起的当下,英伟达能否继续垄断市场,我们边走边看,但黄仁勋以及英伟达肯定充满信心。

因为正如他所说,“摩尔定律已经失去了动力,加速计算让我们能够取得巨大的飞跃。”