上周一,Claude的公司Anthropic发文公开指控三家中国AI公司DeepSeek、Moonshot(Kimi的母公司)、MiniMax对Claude发起了“工业规模”的能力抽取:这些实验室通过约2.4万个欺诈账户与Claude进行了超过1600万次交互,违反了服务条款和区域访问限制。

不仅如此,Anthropic一边强调“蒸馏是一种广泛使用且合法的训练方法”,一边在文章中声称:这种“非法蒸馏”甚至会造成重大的国家安全风险。甚至,他们还强调“如果蒸馏模型被开源,这种风险会成倍增加,因为这些能力会不受任何单一政府控制地自由传播”。

这些言论一出,整个AI圈子都炸了:你还有脸说别人?

蒸馏,怎么非法了

如同Anthropic自己所说的,蒸馏确实是AI行业一个非常常见的训练技术。

简单来说,蒸馏就是指用一个大模型来训练形成自己的小模型,让小模型能够学到大模型的一部分能力,但体积更小、运行更快、成本更低。尤其是把那些云端运行的巨无霸模型,压缩成能在边缘设备/低成本服务器上跑的模型,降低延迟和算力消耗,同时尽量保持效果。

如同老师和学生的关系,蒸馏不是照抄老师给的答案,而是学习老师的解题思路。学生在之后自己解题时,使用的是自己的脑子,跟原始的大模型就没有什么联系了。

Anthropic自己也用蒸馏来做Claude的小模型,比如从Opus蒸馏出Sonnet,再从Sonnet蒸馏出Haiku。OpenAI也这么干,比如从GPT-4蒸馏出GPT-4o mini;Google也这么干,大家都这么干。

就连Anthropic自己的蒸馏历史,也不干不净的,不然也不会有这样的梗图。

问题在于,Anthropic控诉别人是非法窃取Claude的能力。某种程度上说,这确实违反了Anthropic的服务条款,但“违法”?违的是哪个法?

要说违法,Anthropic自己才劣迹斑斑。也正因如此,Anthropic才被AI圈子群嘲。马斯克也评论了这件事,称Anthropic曾因大规模盗取训练数据,最后不得不支付十几亿美金的和解金。

去年9月,Anthropic被发现从盗版网站LibGen和PiLiMi下载了超过700万本书,用来训练Claude。不仅如此,他们还要用这些书建立一个巨大的中央图书馆、意图永久保存。最终,Anthropic支付了超过15亿美金,达成了最终的和解,但和解协议协议不包含“承认不当行为”。这应该是美国版权诉讼史上最大的和解金额案例了。

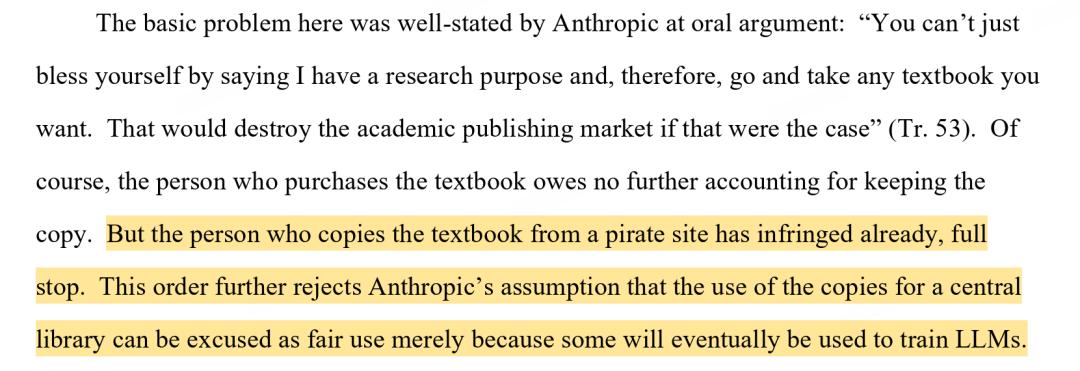

在William Alsup法官此前签署的裁定中明确了两点:

第一,用涉案书籍训练Claude及其前身模型属于合理使用。法官说这种使用是“我们这辈子能看到的最具变革性的使用之一”,因为AI模型训练的目的并非复制或取代作品,而是转个硬弯创造不同的东西。

第二,用盗版来源的电子书去建立并长期保留一个“中央图书馆”,则不是合理使用。法官尤其强烈地否定了“为了后续可能的合理使用目的,就可以先去盗版获取‘初始副本’”的辩解思路,“这种盗版本身是不可救药的侵权”。

本案的法官裁定文件

事情还没完,今年1月,路透社报道显示,Universal Music Group、Concord、ABKCO等出版商在美国加州联邦法院对Anthropic提起诉讼,指控其通过BitTorrent等方式盗版获取含歌词/乐谱/作品的材料,并在训练/输出等环节侵犯超过2万首作品的版权。据悉,本案的索赔金额可能超过30亿美元。

所以你看看,什么叫做双标?

背弃中国,由来已久

由于Anthropic严苛的针对,国内用户的Claude使用体验并不好,主要原因也并非“模型不好用”,而是“可用性不稳定”。

对比ChatGPT,Claude更“六亲不认”。不仅经常触发“地区限制”,而且经常在充值之后就封号,颇有种“收了再宰”的感觉。不同于其他AI公司的产品,比如OpenAI的ChatGPT等也在中国不可用,但像Claude这样发现就封号的还是独一份。

其实,Anthropic对中国的针对由来已久。

去年9月,Anthropic官方发文,要加强对不支持地区的销售限制。公告点名针对“中国这样的敌对国家”,不仅限制直接访问,还把禁用范围扩大到“由不支持司法辖区(如中国)控制”的公司——即便注册在新加坡或美国,只要其直接或间接被“总部在不支持地区”的公司持股超过50%,也会被禁止使用包括Claude在内的商业服务(包含开发者/API场景)。

Anthropic的理由是“可能会利用我们的能力开发最终服务于敌对军事和情报机构以及更广泛的威权目标的应用程序和服务”,“并与总部位于美国及其盟国的信誉良好的科技公司在全球范围内展开竞争”。

Anthropic的CEO Dario Amodel在声明中明确强调AI对“保卫美国及其他民主国家、对抗威权对手”的重要性,并称Anthropic一直在主动把模型部署到美国国防与情报体系中。同时,他声明公司曾放弃“放弃数亿美元收入”,以切断与中国相关公司的使用,打击滥用Claude的网络攻击、以及推动更强的芯片出口管制。

可以说,Anthropic要限制中国AI以及相关产业的发展,完全没在演的。

在最近的控诉中,Anthropic甚至骄傲地宣称他们可以精确定位到某一个账号隶属于Moonshot的哪个员工,并且明确表明他们会对所有他们认定为“非法”的行为,在API中投毒,降低其输出质量。

在文章中,Anhropic自曝记录了所有的请求,以及这些请求的元数据、硬件特征,并且还和其他厂商的数据进行交叉共享。通过这些大规模的数据记录,Anhropic足以根据这些数据分析出账户所属的组织。

除了MooShot,Anthropic还鉴别了MiniMax,甚至还可以拿来推测和印证其产品发布路线图。

这种通过API精准判断出使用者名字和工作单位的行为,无疑是Anthropic在自曝侵犯用户隐私。不夸张地说,Anthropic这波操作,简直就是在印证“为什么AI技术必须是开源的”!

不只针对中国

Anthropic针对中国,已经是摆在台面上的事情,但要说他们完全站在美国政府那一边,又不尽然。

在2月以前,Anthropic的确是“国防/情报体系的重要供应商”。Anthropic在声明中称,Claude已广泛部署在美国国防与国家安全机构,用于情报分析、建模与仿真、作战规划、网络行动等“任务关键”应用。

尼古拉斯·马杜罗被捕后抵达曼哈顿直升机停机坪。图片:XNY/Star Max/GC Images

比如在2月13日,Axios报道称,美军在一次针对委内瑞拉前领导人尼古拉斯·马杜罗(Nicolás Maduro)的行动中“据称使用了Claude”。随后,路透社转述WSJ的报道补充说,Claude是通过Palantir的平台生态进入国防体系。

《纽约时报》报道也曾提到,国防部与Anthropic去年有一份价值2亿美元的试点协议。

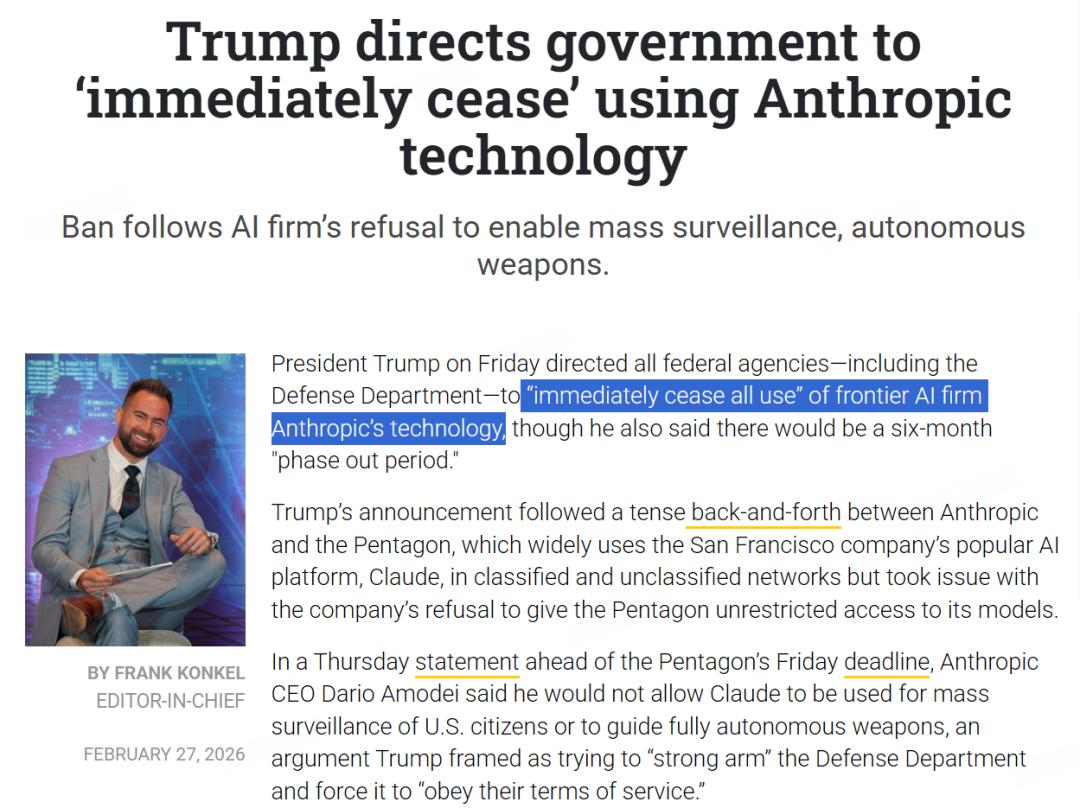

但在最近,在特朗普政府施压背景下,美国国防部长Pete Hegseth召见CEO Amodel到五角大楼会面,讨论Anthropic技术在机密系统中的使用,并要求其遵循国防部与其他AI公司的谈判框架。

面对国防部“任何合法用途”的要求,Anthropic明确表示拒绝,并点名坚持不用于大范围国内监控(Mass domestic surveillance)和完全自主武器(Fully autonomous weapons)。

随后,特朗普在Truth Social上表示将指示所有联邦机构“立即停止使用”Anthropic的技术,并提到会有约六个月的过渡期。国防部长Hegseth也表示将把Anthropic指定为“国家安全供应链风险”。这意味着双方矛盾从“合同条款谈判”升级为“总统层面的政府范围停用与采购系统下架”。

一面强烈制裁中国,一面和美国政府闹掰,这家公司确实有点个性。但生意毕竟是生意,Anthropic没了金主,还能不能撑得下去呢?